Erhalten Sie Zugang zu diesem und mehr als 300000 Büchern ab EUR 5,99 monatlich.

- Herausgeber: marixverlag

- Kategorie: Wissenschaft und neue Technologien

- Serie: Neue Reihe Sachbuch

- Sprache: Deutsch

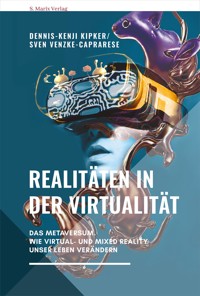

Von der antiken Mythologie bis Star Trek: Schon seit Jahrhunderten imaginieren Menschen, wie wir in der Zukunft leben und wie intelligente Maschinen eines Tages unseren Alltag prägen werden. Die enormen technischen Fortschritte der vergangenen Jahrzehnte haben paradigmatische Veränderungen mit sich gebracht, die es uns bald vielleicht sogar ermöglichen, komplett in virtuelle Welten einzutauchen, in denen die Unterschiede zwischen Realität und Simulation zunehmend verschwimmen. Welche Technologie ist dafür aber erforderlich, welchen Weg ist sie bis jetzt gegangen, welche Potenziale bietet sie, und werden wir mit ihr vielleicht sogar irgendwann an die Grenzen unserer eigenen Existenz herangeführt? Antworten auf all diese Fragen gibt »Realitäten in der Virtualität«, indem es erklärt, was eine Symbiose von Mensch und Technik ausmacht und wie sie uns schon jetzt verändert.

Sie lesen das E-Book in den Legimi-Apps auf:

Seitenzahl: 363

Veröffentlichungsjahr: 2025

Das E-Book (TTS) können Sie hören im Abo „Legimi Premium” in Legimi-Apps auf:

Ähnliche

Dennis-Kenji Kipker / Sven Venzke-Caprarese

Realitäten in der Virtualität

DENNIS-KENJIKIPKER/SVEN VENZKE-CAPRARESE

REALITÄTEN INDER VIRTUALITÄT

DAS METAVERSUM –WIE VIRTUAL UND MIXED REALITYUNSER LEBEN VERÄNDERN

S. Marix Verlag

INHALT

EINFÜHRUNG

KAPITEL 1: VOR DEM EINTAUCHEN: DAS TECHNISCHE FUNDAMENT

Rechenleistung

Netzwerkverbindungen

Technologie zur Vermittlung von Sinneseindrücken

Sensortechnologie

Weitere technologische Bausteine

KAPITEL 2: TISCHTENNIS IM JENSEITS – VIRTUELLE ANWENDUNGEN IM LEBEN UND DANACH

Gaming

Anwendungen für den Büroarbeitsplatz

Industrie 4.0, Prototyping und weitere Anwendungen im Arbeitsumfeld

Lernerfahrungen, Bildung und Ausbildung

Fitness und Meditation

Entertainment

Sexualität und Pornografie

Vergnügungsparks

Landwirtschaft

Digital Afterlife

Sicherheitsbehördliche und militärische Anwendungsszenarien

Marketing, Shopping und virtuelle Einkaufserlebnisse

Digitales Treffen im virtuellen Raum: Social VR

Ein Ausblick auf die virtuelle Zukunft

KAPITEL 3: UNTER AVATAREN: WAS IST DAS »METAVERSUM«?

Nutzergenerierte Inhalte im offenen Metaversum vs. nicht veränderbares Metaversum

Tokenisiertes vs. nicht tokenisiertes Metaversum und NFTs

Weitere Unterscheidungskriterien

KAPITEL 4: VON DAMOKLESSCHWERTERN UND NASA-LABOREN: EINE KURZE GESCHICHTE DER VIRTUELLEN REALITÄT

KAPITEL 5: FÜR DIE FLAMMEN ODER FÜR DIE EWIGKEIT: BLOCKCHAINS, KRYPTOWÄHRUNGEN, KRYPTOKUNST, NFTS, SMART CONTRACTS UND DAOS

Welche Rolle Blockchains noch spielen können

KAPITEL 6: IM CAFÉ AM ENDE DES UNIVERSUMS: DAS METAVERSUM ALS SOCIAL MEDIA 2.0

Echte Erfahrungen und Erlebnisse aus dem Metaversum

Weitere Zukunftsszenarien und offene Rahmenbedingungen

KAPITEL 7: MASCHINENDICHTER UND DENKAPPARATE: KÜNSTLICHE INTELLIGENZ

Die Erstellung von virtuellen Welten

Herausforderungen bei der Entwicklung neuer virtueller Welten

Informatik und Softwareentwicklung

Design

Kunst und Kreativität

Marketing und Kommunikation

Die Möglichkeiten künstlicher Intelligenz im Metaversum und in virtuellen Realitäten

Vom Forschungsgebiet zum Anwendungsfall

Die Anfänge: Sagen von künstlichen Maschinen mit menschlichen Zügen

Die Entwicklung des »McCulloch-Pitts-Neurons«

Die »Dartmouth Conference« als Geburtsstätte der modernen KI-Forschung

Der erste Chatbot der Welt: »ELIZA«

Vom KI-Hype zum »KI-Winter«

Neuer Auftrieb für die KI-Forschung

»Generative AI« als der große Durchbruch

Anwendungsszenarien von künstlicher Intelligenz im Metaversum

Erstellung von 3D-Modellen aus 2D-Grafiken, Text oder Scans echter Objekte

Photogrammetrie und Videogrammetrie

Auslesen von Tiefeninformationen aus 2D-Aufnahmen

Prozedurale Generierung von dreidimensionalen Objekten und Landschaften

KI und NPCs

KI als Universalübersetzer

Die KI erzählt Geschichten - Scripting durch KI

KAPITEL 8: HOMO DIGITALIS: MENSCH-COMPUTER-SCHNITTSTELLEN

Von Frankenstein zum Terminator: die Rezeption von Mensch und Technik in der Populärkultur

Roboter, Cyborgs und Androiden

»Wearable Computing«

2007: Ein Meilenstein in der Entwicklung von Mobile Computing

Vom Smartphone zur Smartwatch

Virtuelle Datenbrillen

Smart Clothes

Soziale Akzeptanz

Von technischen Prothesen zu unsichtbaren Implantaten

Möglichkeiten der Brain-Computer-Interfaces (BCI)

Risiken und Herausforderungen beim Einsatz von BCI

KAPITEL 9: JEDE INNOVATION BIRGT AUCH RISIKEN: EINE KRITISCHE AUSEINANDERSETZUNG MIT DEM METAVERSUM

Privatsphäre und Datenschutz

Digitale Nähe vs. digitale Vereinsamung

Realitätsflucht und Realitätsverlust

Weitere Monopolisierung unserer digitalen Welt

Ethik, Verantwortung, Zugänglichkeit und Barrierefreiheit

Zwei-Klassen-Informationsgesellschaft

Neue juristische Herausforderungen im globalen Kontext

Big Tech, Gatekeeper und Plattformregulierung

Desinformation und Manipulation

Informations- und Cybersicherheit

Ökologie, Nachhaltigkeit und Verantwortung

Demokratieförderung und virtuelle Staatenbildung

Reizüberflutung und Entertainisierung

EPILOG

ÜBER DAS BUCHCOVER

DANKSAGUNG

LITERATURVERZEICHNIS

MEHR VON DIESER REIHE

EINFÜHRUNG

Was ist real? Diese Frage beschäftigt die Menschheit spätestens seit Anbeginn der Philosophie. Zwar wird eine endgültige Antwort vermutlich nie gefunden werden können, bei der Suche danach wird man aber nicht umhinkommen, sich mit den menschlichen Sinneswahrnehmungen zu beschäftigen.

Zur körperlichen Wahrnehmung der Welt stehen uns bei engerer Betrachtung fünf Sinne zur Verfügung: Sehen, Hören, Riechen, Schmecken und Tasten. Mit zunehmender Technisierung werden diese Sinne neuen Eindrücken ausgesetzt. Eine Errungenschaft zur Vermittlung solcher Eindrücke sticht dabei besonders hervor: Die Erfindung der Bildschirme. Diese wurden seither konsequent weiterentwickelt und nehmen immer mehr unsere Aufmerksamkeit und unser Leben in Beschlag: Fernsehgeräte, Computermonitore, Tablet- und Smartphone-Displays bis hin zu digitalen Armbanduhren prägen mittlerweile den Alltag der meisten Menschen, und das nicht nur in den Industrienationen und Dienstleistungsgesellschaften. Je nach Beruf oder Lebensmodell blicken wir vielleicht schon morgens auf das Smartphone, verbringen gut ein Drittel des Tages im Büro vor einem oder mehreren Bildschirmen, um in der Freizeit weitere Bildschirmzeit zu akkumulieren – sei es vor dem Fernseher, vor Mobilgeräten, Monitoren oder vor Konsolen und Gaming-PCs. Daneben werden wir aber auch in der weiteren Umgebung fast beiläufig von Bildschirmen begleitet: Bordinstrumente im Auto, Bedienelemente von Maschinen, digitale Werbedisplays, Infotafeln allerorts. Bildschirminhalte sind allgegenwärtiger, als wir uns bewusst sind, und die wahrnehmbare Realität wird durch diese digitalen Inhalte verändert. Denn ohne die tiefergehende Frage, was eigentlich real ist, im philosophischen Kontext zu beantworten, muss man doch feststellen, dass die auf Bildschirmen dargestellten Bilder ganz konkret die physische Welt verändern, nämlich durch die Darstellung von Bildpunkten in verschiedenen Farben. Bildschirme sind daher eine Quelle der von uns erlebbaren Sinneseindrücke.

Sicherlich trifft ein Szenario, in dem wir uns täglich für eine Vielzahl von Stunden mit Bildschirminhalten umgeben, nicht für jeden Menschen zu. Je nach Beruf, Wohnort und persönlicher Einstellung ist es durchaus möglich, sich dem Einfluss der digitalen Inhalte zu entziehen bzw. diesen bewusst zu verringern. Eine solche Einflussverringerung, wenn sie denn persönlich gewollt ist, wird jedoch immer schwieriger. Denn die Digitalisierung schreitet unaufhaltsam voran und ein völliger Verzicht auf die Wahrnehmung solcher Inhalte kann jenseits der romantischen Vorstellung eines naturnahen Lebens auch dazu führen, dass man sich in gewisser Weise »abgehängt« von der Welt fühlt und möglicherweise von vielen Informations- und Interaktionsmöglichkeiten auch tatsächlich abgeschnitten ist. Wirkliche digitale Askese wird deshalb immer schwieriger. Auf der anderen Seite gibt es Lebensmodelle, die gezielt nach jener Verquickung suchen: Digital Natives, Digital Nomads, Gamer und Gamerinnen, Nerds, Metaverse Natives und sonstige Technikenthusiasten integrieren digitale Inhalte bewusst immer stärker in ihren Alltag. Und die Möglichkeiten, die sich dazu bieten, werden zunehmend ausgefeilter. Waren Bildschirminhalte zu Beginn nur bewegte Bilder, die man passiv als Zuschauer wahrnehmen konnte, wurden diese mit der Zeit immer interaktiver. Seit dem Aufkommen der ersten Personal Computer und des Internets vor mittlerweile mehreren Jahrzehnten stiegen und steigen die Möglichkeiten zur Darstellung digitaler Inhalte rasant an. Dabei wird bereits heute deutlich, wie sehr allein die beiden genannten technischen Errungenschaften einen Einfluss auf unsere Lebensweise ausgeübt haben und kulturelle sowie gesellschaftliche Fragen und Kontroversen an den unterschiedlichsten Stellen unseres Lebens aufwerfen. Im Hinblick auf die Einführung des Internets kann insofern fast von einer Entwicklung mit disruptivem Einfluss gesprochen werden. Hinzu kommen weitere Entwicklungen im Bereich der Künstlichen Intelligenz, die zur Generierung von digitalen Inhalten genutzt werden kann. All dies sind wohl nur die ersten Schritte auf dem Weg hin zu einer weitaus tiefer digitalisierten Gesellschaft, als wir sie jemals gekannt haben. Die Kombination vorhandener und die Entwicklung neuer Technologien wird in Zukunft vermutlich ganz erhebliche Auswirkungen auf unseren Alltag haben und uns in virtuelle Realitäten bislang unbekannter Ausmaße eintauchen lassen. Wir könnten vollkommen immersiv in virtuellen Welten versinken oder durch die Überlagerung der natürlichen Welt mit zusätzlichen digitalen Schichten eine neue Sicht auf die Welt bekommen.

Derzeit stehen wir an der Schwelle zu einer solchen neuen Welt, die wir uns gegenwärtig noch kaum vorstellen können. Das Gefühl des Eintauchens in diese digitale Welt, also das »Mittendrin-Erlebnis«, kann als Immersion bezeichnet werden. Die höchste Ausprägung wäre in der Theorie wohl das Vergessen der sonstigen realen Umgebung oder der Wegfall von menschlichen Unterscheidungsmöglichkeiten zwischen der realen Umgebung und der virtuellen Realität. Doch selbst wenn man seine sonstige reale Umgebung nicht vergisst, wird der Grad der Immersion vermutlich immer höher und das Vordringen in den digitalen Kaninchenbau immer tiefer. Dabei werden in Zukunft verschiedene technische Entwicklungen eine Rolle spielen, die in ihrer Kombination die Welt verändern könnten. Der erste Grundstein ist gelegt. Die weitere Reise liegt nun vor uns und mit ihr die damit verbundenen Herausforderungen.

KAPITEL 1: VOR DEM EINTAUCHEN: DAS TECHNISCHE FUNDAMENT

Um überhaupt den Eindruck einer virtuellen Realität zu erzeugen, die zu jenem »Mittendrin-Erlebnis« führt, das wir als tiefergehende Immersion bezeichnen würden, bedarf es einer ganzen Reihe an technischen Grundlagen. Diese stellen bildlich gesprochen das Fundament dar, auf dem virtuelle Realitäten errichtet werden können.

Rechenleistung

Um digitale Inhalte darzustellen und interaktiv zu gestalten, braucht es Rechenleistung. Sie ist der erste Baustein einer digitalisierten Welt und wird immer leichter und kostengünstiger verfügbar. Die Rechenleistung, die noch vor 30 Jahren Großrechnern von Universitäten oder militärischen Einrichtungen vorbehalten war, tragen wir mittlerweile ganztags akkubetrieben in Form von Smartphones in unserer Hosentasche herum. Doch mit der Entwicklung ist dabei noch lange nicht Schluss. Zwar ist fraglich, ob sich das »Mooresche Gesetz«, nach welchem sich die Leistung von Mikroprozessoren alle zwei Jahre verdoppelt, dauerhaft aufrechterhalten lässt. Denn in der Mikroprozessor-Herstellung werden aufgrund immer kleiner werdender Transistorenabstände allmählich physische Hürden erreicht. Allerdings gibt es auch hier schon neue Herstellungs- und Produktionsstrategien und letztlich wird sich der menschliche Erfindergeist wohl nicht aufhalten lassen. Es ist daher davon auszugehen, dass das Vorhandensein ausreichender Rechenleistung zum dauerhaften Standard wird. Mittlerweile könnte man sich zwar die Frage stellen, ob die aktuell oder demnächst verfügbare Rechenleistung für die alltäglichen Anwendungen nicht schon ausreichend ist und es daher keiner weiteren Steigerung bedarf. Oft mag dies sogar der Fall sein, allerdings steigt auch der Rechenleistungsbedarf von digitalen Anwendungen, die sich auf dem Weg von der bereits bekannten Interaktivität hin zur Immersion befinden. Für ein modernes Computer- oder Konsolenspiel, das auf eine quasi-realistische Darstellung der Umgebung abzielt, kann es kaum genug Rechenleistung geben. Schon die Berechnung der grafischen Umgebung benötigt immense Rechenleistung, und selbst wenn diese steigt, so steigen gleichzeitig auch die technischen Anforderungen für diese Darstellung. Hinzu kommt die Nutzung von immer anspruchsvolleren Physik-Engines und die Berechnung von weiteren Spiel- bzw. Umgebungsdynamiken, zum Beispiel das Verhalten von Computergegnern und Nichtspielercharakteren. An dieser Stelle kommt ein weiteres und (noch) sehr rechenintensives Potenzial moderner Anwendungen zum Tragen: der Einsatz von künstlicher Intelligenz, mit deren Möglichkeiten zur Generierung von Inhalten und zur Steuerung von Interaktionen wir uns in einem späteren Kapitel dieses Buches intensiver beschäftigen werden. Es bleibt an diesem Punkt aber bereits eines festzustellen: Die digitalen Inhalte, die uns auf Bildschirmen begegnen und mit denen wir interagieren, werden immer leistungsfähiger und weben sich in unseren Alltag immer natürlicher und zunehmend ohne Medienbrüche ein. Wer aktuell der Ansicht ist, dass dies nur die bereits genannten Technikenthusiasten betreffen wird, der wird sich in Zukunft vielleicht wundern.

Netzwerkverbindungen

Neben besagten Grundlagen spielt ein weiterer technischer Faktor eine Rolle, der unser Erlebnis digitaler Inhalte schon jetzt maßgeblich beeinflusst – das Vorhandensein mächtiger Netzwerkverbindungen. Dies ist der zweite Baustein des technischen Fundaments einer tiefergehenden Immersion – und viele kennen es: Sobald das Internet weg oder zu langsam ist, entsteht bei vielen Menschen sofort Unmut. Denn Netzwerkverbindungen sind erforderlich, um die digitale Interaktion mit anderen Menschen und Maschinen in Nahezu-Echtzeit abzubilden und um den Zugriff auf nicht lokal verfügbare Informationen zu ermöglichen. Darüber hinaus müssen je nach Anwendung gegebenenfalls lokal erhobene oder erzeugte Informationen möglichst schnell übermittelt werden. Zwar werden auch hier die Möglichkeiten immer zahlreicher, allerdings werden auch die technischen Anforderungen immer höher. Streaming-Dienste wie Netflix rechnen die zu übertragenden Inhalte zu Lasten der Bildqualität immer noch künstlich herunter, um Bandbreite zu sparen und die Netzwerkverbindungen nicht zu überlasten. Dabei müssen diese nicht nur mit möglichst hoher Bandbreite Daten übertragen. Es kommt zudem darauf an, die Informationen mit möglichst kleinen Reaktionszeiten zu übertragen. Hierauf sind insbesondere Anwendungen angewiesen, die in Nahezu-Echtzeit stattfinden müssen. Das gilt zum Beispiel für Computerspiele, in denen mehrere Spieler aufeinandertreffen. Viele aktuelle Computerspiele begrenzen derzeit noch die Anzahl der gleichzeitig miteinander interagierenden Spieler und Videokonferenztools sind ab einer gewissen Nutzeranzahl nur mäßig brauchbar. Vermutlich entfalten viele Anwendungen aufgrund von mangelhaften Netzwerkverbindungen derzeit noch nicht ihr vollständiges Potenzial. Das gilt erst recht, wenn eine weitere Anforderung hinzutritt, nämlich das Vorhandensein allgegenwärtiger mobiler Netze, die jederzeit sowohl eine hohe Bandbreite als auch eine geringe Reaktionszeit aufweisen. Zurzeit ist dies in vielen Staaten noch nicht flächendeckend in gleichbleibend hoher Qualität der Fall. Mit steigender Verfügbarkeit entsprechender Netzwerkverbindungen aber werden uns in Zukunft vermutlich Anwendungsfälle begegnen, von denen wir heute nur träumen können oder für die uns vielleicht noch die Fantasie fehlt.

Technologie zur Vermittlung von Sinneseindrücken

Ein dritter Baustein für Immersion ist die Technologie zur Vermittlung von Sinneseindrücken. Bildschirme sind hierbei vermutlich nur der Anfang und die vorhandene Bildschirm- bzw. Darstellungstechnologie ist im Gegensatz zu jener zur Vermittlung von Höreindrücken noch relativ unzufriedenstellend entwickelt. Aktuell reicht sie zwar zur Darstellung auf starren sowie auf den ersten biegbaren Displays aus und auch Virtual-Reality-Headsets funktionieren damit schon einigermaßen immersiv. Allerdings ist die Technik an dieser Stelle noch ausbaufähig.

Insbesondere im Hinblick auf künftige Augmented-Reality-Anwendungen zeigt sich, wie beschränkt die Möglichkeiten derzeit noch sind. Denn es ist eine große Herausforderung, die Inhalte, die man schon auf geschlossenen VR-Headsets anzeigen kann, in Gläsern offener Brillen darzustellen. Transparente Brillen, die in der Lage sind, über ihre Gläser weitere digitale Inhalte zu legen, funktionieren noch nicht gut genug für ein immersives Nutzererlebnis. Auch andere Möglichkeiten, wie Kontaktlinsen zur Darstellung von Bildschirminhalten oder gar Projektionstechniken, die Bilder direkt in die Iris des Nutzers werfen, befinden sich allenfalls im Experimentierstadium. Ganz weit am Horizont und aktuell kaum sichtbar, lassen sich Technologien zu Gehirn-Computer-Schnittstellen erahnen, die bei einem vermutlich sehr weit in der Zukunft liegenden Reifegrad alle Sinneseindrücke im engeren Sinne stimulieren bzw. erzeugen können, also Sehen, Hören, Riechen, Schmecken, Tasten. Dieser technologischen Herausforderung widmen wir uns in einem eigenen Kapitel. Darüber hinaus könnten auch weitere Sinneseindrücke stimuliert werden, wie der Temperatursinn, die Schmerzempfindung, der Gleichgewichtssinn und die Tiefensensibilität. Die Entwicklung einer ausgereiften Gehirn-Computer-Schnittstelle könnte in Zukunft jedoch tatsächlich für etwas sorgen, das wir heute nur aus Science-Fiction-Romanen kennen: Eine von der realen Welt nicht mehr unterscheidbare virtuelle Realität, in der die Grenzen von Körper und Geist verschwimmen.

Sensortechnologie

Die Sensortechnologie schließlich ist ein weiterer Baustein für die Digitalisierung unseres Alltags. Dieser vierte Baustein ist erforderlich, um die digitale Schicht passgenau über die natürliche Welt zu legen bzw. um die natürliche Welt passgenau in der virtuellen Realität darzustellen. Aktuell im Einsatz sind hier zum Beispiel unterschiedlichste Sensoren zur Erfassung der eigenen Körperbewegungen, mit deren Hilfe in virtuellen Welten Avatare gesteuert und Interaktionen abgebildet werden können. Hier wird in Zukunft je nach Anwendung möglichst jede Körperbewegung erfasst werden, also auch Kopf- und Augenbewegungen, Mimik sowie Lippen-, Finger-, Hand-, Arm- und Beinbewegungen und alles Vorstellbare an körperlicher Interaktion. Auch könnten weitere Körpermesswerte erfasst und in die digitale Welt übertragen werden. Die Arbeit der Sensoren geht aber über den Körper des Nutzers hinaus. So verfügen bereits heute viele Endgeräte, etwa moderne Smartphones, über radarähnliche Sensoren, die mittels Laserstrahlen in der Lage sind, die Umgebung in Echtzeit und mit Tiefeninformationen zu erfassen und abzubilden – ähnlich wie ein mobiler 3D-Scanner. Diese sogenannten »LiDAR«-Sensoren sind nur ein erster Schritt, dem weitere technologische Reifegrade folgen werden. Mithilfe solcher oder ähnlicher Sensoren kann ein tiefer Digitalisierungsgrad der Welt erreicht werden und es wird möglich, die natürliche und die digitale Welt übereinander zu legen, bis diese miteinander verschmelzen. Eine solche Verschmelzung der echten und der physischen Welt kann sowohl in Virtual- als auch in Augmented-Reality-Headsets abgebildet werden und wird dann auch als »Mixed Reality« bezeichnet.

Weitere technologische Bausteine

Neben den bereits genannten kann eine ganze Reihe weiterer Bausteine künftig eine Rolle spielen, zum Beispiel Aktoren, die die physische Welt verändern, also etwa Motoren um Türen zu öffnen, physische Warenauslagen anzupassen oder haptisches Feedback zu erzeugen. Die Weiterentwicklung von Akkus kann ebenfalls eine größere Rolle spielen, und auch die künstliche Intelligenz wird vermutlich ein ganz eigener Baustein für künftige virtuelle Welten sein. So wäre es möglich, dass sie die teilweise komplexe Umgebung virtueller Welten nach Vorgabe von Menschen erzeugt und es so auch normalen Nutzern ermöglicht wird, komplexe Welten voller Inhalt und Abwechslungsreichtum zu erschaffen. Insgesamt wird die Kombination der verschiedenen technischen Möglichkeiten vermutlich dazu führen, dass wir eine immer weiter verwobene digitale Schicht über die natürliche Welt legen und der Grad der Immersion dabei ständig ansteigt. Begriffe wie »Virtual Reality«, »Mixed Reality«, »Augmented Reality« und »Metaversum« werden wohl schon bald unseren Alltag erreichen. Weitere, relativ neue Technologien wie die Blockchain-Technologie und sogenannte Non-Fungible-Tokens, die ebenfalls in den kommenden Kapiteln erklärt werden, können darüber hinaus zunehmend eine Rolle spielen, um virtuelles Eigentum zu repräsentieren. Und letztlich wird es auch eine entscheidende Frage sein, welche Anwendungen und Plattformen im Hinblick auf die Darstellung von virtuellen Realitäten zum Einsatz kommen und von wem diese betrieben werden.

Welche gesellschaftlichen, ethischen, philosophischen, technischen, rechtlichen, sozialen, ökologischen und kulturellen Fragen sich uns auf diesem Weg in eine neue digitale Zukunft stellen werden, lässt sich vermutlich nur erahnen und wir werden hierauf am Ende dieses Buches noch näher eingehen. Wenn man die Gedanken an eine mögliche Zukunft auf die Spitze treibt, könnte es sogar sein, dass wir bei dieser immer weiter fortschreitenden Entwicklung letztlich an einen Punkt gelangen werden, an dem wir uns im Sinne des eingangs erwähnten platonischen Höhlengleichnisses die Frage stellen müssen, wer hier eigentlich der Gefesselte ist: Derjenige, der die Welt durch seine digitale Brille betrachtet oder derjenige, der sich diese Ebene durch Verzicht oder Zwang nicht erschließt bzw. erschließen kann.

KAPITEL 2: TISCHTENNIS IM JENSEITS – VIRTUELLE ANWENDUNGEN IM LEBEN UND DANACH

Die Erfahrungen, die man mit Virtual-, Mixed- und Augmented-Reality-Anwendungen erleben kann, sind vielfältig. In diesem Kapitel wollen wir einen ersten Überblick über mögliche praktische Einsatzszenarien geben. Da den denkbaren Anwendungen kaum Grenzen gesetzt sind, hat dieser Überblick keinen Anspruch auf Vollständigkeit, sondern soll vielmehr ein Gefühl dafür vermitteln, was Virtual und Mixed Reality alles möglich machen können und vielfach heute schon möglich machen und welchen Einfluss sie dadurch auf das menschliche Leben insgesamt entwickeln können.

Gaming

Die ersten Anwendungen für Virtual-Reality-Headsets, die von einer breiteren Masse genutzt wurden, waren Spiele. Bereits die ersten VR-Erfahrungen in den Arcade-Hallen der späten 1980er und der 1990er Jahre zeigten, dass sich VR-Anwendungen eher auf die Zielgruppe der privaten Endbenutzer, um nicht zu sagen der Gamerinnen und Gamer, konzentrieren würden. Tatsächlich wurden dann auch seit dem Durchbruch, den die damals noch recht unbekannte Firma Oculus VR im Jahr 2013 mit dem VR-Headset »Oculus Rift« und dann mit der »Oculus Quest« schaffte, zahlreiche Spieletitel entwickelt, die für VR-Erfahrungen ausgelegt waren. Entsprechend kompatible Autorennspiele machten es fortan möglich, dass sich Spieler direkt in ihrem Fahrzeug befanden und das Renngeschehen mit 360-Grad-Rundumblick absolvieren konnten. Spieler, die zusätzlich über ein Lenkrad als Eingabegerät verfügten, bot sich eine weitere Tiefe der Immersion in das Spiel. Es fehlte zwar noch das Erlebnis des Fahrtwindes sowie der Fliehkräfte, und das Fahren von Kurven war, je nach Lenkradsystem, allenfalls als Ruckeln über das Lenkrad zu spüren. Allerdings war der Grad der Immersion mit dem vorherigen Erleben am Bildschirm kaum noch zu vergleichen – und damit sind keineswegs pixelige Rennspiele aus den 1980er Jahren gemeint. Die VR-Erfahrung lieferte dabei so überragende Eindrücke, dass das eigentliche Spielgeschehen gelegentlich sogar in den Hintergrund rückte. Man stelle sich nur einmal vor, dass man als Fahrer eines Formel-1-Rennwagens in langsamem Tempo die Serpentinen eines Berges in den Pyrenäen hinauffährt, das Fahrzeug stoppt, aussteigt, ein paar Schritte Richtung Abhang geht, nur um das Panorama des Tals bei strahlendem Sonnenschein auf sich wirken zu lassen. Eine solche Erfahrung machten bereits die ersten frühen VR-Spiele möglich, wobei das Aussteigen aus dem Auto und das Gehen in Richtung Tal tatsächlich in der echten Welt durch das Aufstehen vom Stuhl und das Gehen in eine bestimmte Richtung erfahren werden konnte.

Aber auch andere Spielegenres setzten sich im Hinblick auf ihre Erlebbarkeit in VR-Umgebungen immer weiter durch. Sportspiele, wie zum Beispiel virtuelles Tennis, Tischtennis oder Golfen standen bereits früh als VR-Spiele zur Verfügung. Auch hier war der Grad der Immersion mit bisherigen Spieleerfahrungen auf klassischen Computerbildschirmen kaum vergleichbar. Allein das Beispiel von virtuellem Tischtennis mag auch Lesern, die noch nie ein VR-Headset benutzt haben, ein Gefühl davon geben, wie unterschiedlich real solch ein computergeneriertes Spiel erfahren werden kann. Man stelle sich eine Tischtennispartie auf einem klassischen Computerbildschirm vor. Eine Bewegung wäre hier in der Regel ausschließlich mit Maus und Tastatur oder wahlweise per Gamepad möglich. Die zweidimensionale Darstellung der dreidimensionalen Umgebung würde zwar schon ein Gefühl für das Spiel aufkommen lassen und sicherlich auch eine Menge Spaß bieten können. Ein Tischtennisspiel in einer VR-Umgebung böte jedoch einen völlig anderen Grad der virtuellen Wahrnehmung. Denn tatsächlich würde man die Spielwelt hier durch die Augen des virtuellen Spielers sehen. Sowohl der Spieler als auch der Tischtennisschläger würden nicht mehr durch klassische Controller gesteuert werden, sondern durch die echten Bewegungen von Hand und Arm des Spielers. So würde das Headset die Bewegungen des Spielers dazu nutzen, um dessen Position in der virtuellen Welt zu berechnen. Man hätte also tatsächlich das Gefühl, dass man sich wie bei einer Partie Tischtennis in der echten Welt allein durch seine Bein- und Körperbewegungen durch den Raum und um seinen Teil der Tischtennisplatte bewegt. Der Schläger selbst würde ebenfalls durch die eigenen Bewegungen in der echten Welt gesteuert. Der Controller, den man, ähnlich wie einen echten Tischtennisschläger, in der Hand hält, würde von Sensoren erkannt und die Bewegungen in die virtuelle Spielewelt übernommen. Auf diese Weise wäre eine sehr realistische Darstellung der Ebenen eines Tischtennisspiels möglich. Hobbyspieler würden möglicherweise kaum noch einen Unterschied zu einem echten Tischtennisspiel bemerken und mit besseren Displays, realistischer dargestellten Umgebungen sowie besser berechneter Physik würden die Grenzen zur Realität vermutlich schon bald verschwimmen. Darüber hinaus ist es in Zukunft auch denkbar, dass ein Spieler gar keinen Controller mehr in der Hand halten muss, sondern stattdessen einen echten Tischtennisschläger benutzen kann, der von den Sensoren erkannt wird. Lediglich die detailgetreue Nachbildung des haptischen Feedbacks des auf den Schläger auftreffenden Balls wäre noch schwer umzusetzen. Allerdings ist dieses Feedback bei einem Tischtennisspiel so gering, dass es bei Hobbyspielern die Tiefe der Wahrnehmung kaum beeinflussen würde. Das Beispiel des virtuellen Tischtennisspiels verdeutlicht gut, wie weit sich die mögliche Immersion beim Erlebnis von Spielen in den letzten Jahrzehnten entwickelt hat. Man führe sich vor dem Hintergrund des eben dargestellten Spieleerlebnisses nur einmal die Anfänge des virtuellen Tischtennis aus den 1970er Jahren vor Augen, als eine Firma Namens Atari das erste Spiel dieser Art auf Spielhallen- und Fernsehbildschirmen ermöglichte. Das als Pong in die Spielegeschichte eingegangene Arcade Game bestand damals lediglich aus einer monochromen, zweidimensionalen Darstellung und ermöglichte das rein vertikale Steuern eines Balkens, um ein über den Bildschirm fliegendes Quadrat in die andere Spielhälfte zu befördern. Um nicht falsch verstanden zu werden: Sicherlich können beide Formen des virtuellen Tischtennisspiels eine gehörige Portion Spaß bieten. Die VR-Erfahrung ist jedoch so realitätsnah, dass sie das persönliche Fitnesslevel des Nutzers unter Umständen schnell an seine Grenzen führt und damit einem echten Spiel schon sehr nahe kommt.

Neben virtuellen Autorennen und Tischtennisspielen haben sich auch eine Reihe weiterer Spielegenres durchgesetzt, die Spieler mithilfe von VR-Headsets in virtuelle Welten entführen. Stellen Sie sich vor, wie es sich anfühlen würde, wenn man in die Rolle eines mittelalterlichen Bogenschützen schlüpfte und die Sehne des Bogens allein durch die Bewegung seiner Hände und Arme spannte. Oder aber, wenn man ein Schwert- oder Boxkampfduell mit einem virtuellen Gegner bestreiten würde. Auch sogenannte »Shooter« haben ihren Weg in die VR-Headsets gefunden. Um nur ein solches Spiel zu nennen, sei an dieser Stelle der im Jahr 2020 erschienene Ego-Shooter Half-Life: Alyx erwähnt, der zu dieser Zeit wohl einen der immersivsten VR-Shooter darstellte. Beachtlich an der Entwicklung war dabei, dass sich der Spieleentwickler Valve dazu entschloss, den Titel ausschließlich als VR-Spiel zu entwickeln, um die Erfahrungen der Spieler allein auf diese Umgebung abstimmen zu können. Außerdem handelte es sich bei diesem Spiel wohl um einen der ersten großen sogenannten »Triple-A-Titel« für VR-Headsets – also um ein Spiel, dass mit sehr großem Budget und erheblichen Produktionskosten entwickelt wurde. Half-Life: Alyx kann somit als einer der ersten VR-Blockbuster bezeichnet werden. Und tatsächlich war die Erfahrung im Jahr 2020 aufgrund der Qualität des Spiels und der Gestaltung der Spieleumgebung bahnbrechend. Auch bei dieser Software trat an vielen Stellen das eigentliche Spielgeschehen in den Hintergrund: So bot bereits die Eröffnungsszene des Spiels eine regelrechte Einladung, mit der Welt zu interagieren. In dieser steht man auf dem großen Balkon eines mehrstöckigen Hauses und kann bereits hier seine Umgebung erkunden. Die Darstellung ist dabei so realistisch, dass man in tiefe Straßenschluchten schauen kann, wenn man sich über das Geländer lehnt. Auf dem Balkon selbst stehen allerlei Dinge herum, die zur Interaktion einladen, etwa ein Radio mit Knöpfen, an denen man drehen kann, leere Getränkedosen, die man in die Hand nehmen und vom Balkon auf die tieferliegende Straße werfen kann; am Horizont bietet sich das dystopische Bild einer am Himmel hängenden Stadt und wenn man vom Balkon in den nächsten Raum geht, befindet sich hier eine Glasscheibe, die mit der Story zwar unmittelbar nichts zu tun hat, auf der man aber mit den im Raum herumliegenden Stiften malen kann. Etwas später im Spiel begegnet man riesigen Walkern, die so bedrohlich wirken wie jene aus dem Roman Krieg der Welten von H. G. Wells, regelrechte Höllenmaschinen. Obwohl die Erfahrung dieses Ego-Shooters im weiteren Spielverlauf als durchaus realitätsnah bezeichnet werden kann, zeigten sich auch bei diesem Spiel noch einige technische Beschränkungen, die sich nach wie vor auf viele VR-Erlebnisse übertragen lassen. Die erste Beschränkung hängt dabei mit der Bewegung des Spielers zusammen. Grundsätzlich lassen sich drei verschiedene Möglichkeiten unterscheiden, um sich in VR-Umgebungen zu bewegen: Führt man sich zunächst eine virtuelle Welt vor Augen, in der man seine Spielfigur bewegen möchte, so wäre die immersivste Bewegungsform hier wohl die Abbildung der Bewegungen der echten Welt in der virtuellen Welt. Spieler würden hierbei aber schnell an ganz konkrete Grenzen stoßen, nämlich an die Wände des Zimmers, in dem man spielt oder sonstige physische Begrenzungen der echten Welt wie zum Beispiel umherstehende Möbelstücke. Mit Ausnahme von einigen besonderen VR-Anwendungen, die extra auf die vorhandene physische Welt abgestimmt wurden, lässt sich diese Bewegungsform allein deshalb nicht übergreifend auf alle VR-Erfahrungen anwenden. Sofern die Größe des Raumes stimmt und der Spieler zum Beispiel nur virtuelles Tischtennis spielen möchte, reicht ein realistisches Bewegungstracking als Bewegungsform für die VR-Erfahrung wohl aus. Ein Ego-Shooter wie Half-Life: Alyx würde jedoch schnell die Grenzen dieses physisch zur Verfügung stehenden und damit begrenzten Raumes sprengen. Wie sich die Technologie dahingehend entwickeln wird, ist noch nicht wirklich absehbar. So gibt es schon seit längerer Zeit Geräte, die versuchen, eine grenzenlose echte Bewegung im virtuellen Raum zur Verfügung zu stellen. Sie bieten spezielle Plattformen und Untergründe an, auf denen sich Spieler relativ natürlich bewegen können sollen, ohne von der Stelle zu kommen. Solche Geräte ähneln multidirektionalen Laufbändern oder Laufkäfigen und sollen dem Nutzer die Möglichkeit geben, sich in einem begrenzten physischen Raum theoretisch unbegrenzt virtuell auf der Stelle fortzubewegen. Ein 5-Kilometerlauf in der virtuellen Realität wäre auf diese Weise möglich, selbst wenn dem Spieler nur ein kleines Zimmer zur Verfügung stünde. Die Immersion solcher 360-Grad-Laufbandplattformen, auch »Omni-Directional-Treadmills« genannt, wird jedoch kaum mit der Erfahrung echter Bewegung zu vergleichen sein.

Auch die sonstigen Sinneseindrücke, wie etwa Gerüche oder das Fühlen von Widerstand lassen sich zurzeit nur schwer umsetzen. Zwar gibt es auch hier erste Versuche, haptisches Feedback in der echten Welt anhand von Informationen aus der virtuellen Welt zu erzeugen. So existieren bereits haptische Westen, die sich Spieler anziehen können, um zum Beispiel mittels Vibrationen ein Gefühl dafür zu bekommen, an welcher Stelle des Körpers man bei einem virtuellen Schusswechsel getroffen wurde. Wirklich praktikabel und immersiv ist dies jedoch noch nicht. Beeindruckender sind da schon eher große Hydraulikgestelle, die einen Sitz beherbergen, in dem der Spieler Platz nehmen kann. Durch das hydraulische System kann der Sitz dann in verschiedene Richtungen des Raumes bewegt werden und den Eindruck erzeugen, dass man um die Kurve fährt oder in den Sitz gepresst wird. Solche hydraulischen Bewegungssysteme können zum Beispiel gut bei Autorennsimulationen oder Flugzeugsimulationen zum Einsatz kommen. Allerdings benötigen sie teilweise einen eigenen Raum und die Kosten für leistungsfähige Systeme erreichen schnell fünfstellige Beträge. Und selbst wenn man ein solches System hätte, könnte man zwar die Rennsimulation relativ immersiv spielen, nicht jedoch den Ego Shooter.

Der Weg hin zu einer Umgebung, die dem Holodeck in der Science-Fiction-Serie Star Trek ähnelt oder den Immersionskabinen im Roman Ready Player One von Ernest Cline scheint also noch sehr weit. Wir wollen daher zunächst zu der Frage zurückkehren, welche Bewegungsformen in der virtuellen Realität noch zur Verfügung stehen.

Am Beispiel von Half-Life: Alyx haben wir gesehen, dass eine echte Bewegungserkennung zwar das immersivste Erlebnis erlaubt, jedoch schnell an praktische Grenzen stoßen würde. Tatsächlich hat sich bei VR-Erfahrungen daher eine weitere Form der Bewegungssteuerung durchgesetzt, das sogenannte »Teleportieren«. In VR-Anwendungen, die die Bewegungsform des Teleportierens unterstützen, hat der User meist die Möglichkeit, per Knopfdruck einen virtuellen Lichtbogen durch den Raum zu bewegen, an dessen Ende sich ein Kreis befindet, der das Teleportationsziel darstellt. Auf diese Weise springt der Spieler durch den virtuellen Raum, ohne reale Gehbewegungen zu machen. Diese Form der Bewegung macht es zum Beispiel möglich, dass auch Spieler, die kaum Platz in der echten Welt zur Verfügung haben und einen bewegungsintensiven Shooter spielen wollen, dies sitzend oder stehend tun können. Als dritte Bewegungsform kommt in VR-Umgebungen dann häufig noch eine als »Lokomotion« bezeichnete Fortbewegung zum Einsatz. Hierbei steuern Spieler, zumeist über einen am in der Hand gehaltenen Controller angebrachten Stick, die Bewegungen. Im Zusammenspiel mit der Hand- oder Kopfbewegung geht der Spieler in der virtuellen Welt auf diese Weise flüssig durch den Raum, ohne dass er sich in der echten Welt bewegen muss. Tatsächlich erlauben viele Spiele auch eine Kombination der eben beschriebenen Bewegungsformen. Wenn ein Spieler sein Wohnzimmer freistellt, um eine Fläche für das VR-Erlebnis zu schaffen, dann kann er sich innerhalb dieser Grenzen durch echte Bewegungen in der virtuellen Welt bewegen. Es ist also zum Beispiel möglich, Geschossen auszuweichen, sich auf den Boden zu werfen, hinter virtuellen Wänden in Deckung zu gehen, sich hinzuhocken und auch ein paar echte Schritte durch den virtuellen Raum zu gehen. Erreicht der Spieler auf diese Weise eine vorher eingestellte Spielebegrenzung im echten Raum, wird ihm dies im Spiel, meist durch ein Gitter, angezeigt. Es ist dann möglich, sich durch die Nutzung der Teleportationsfunktion oder durch Lokomotion wieder so im virtuellen Raum zu positionieren, dass man sich in der echten Welt nur umdrehen muss und den vorhandenen Raum wieder für die echte Bewegungssteuerung nutzen kann. Geübte Spieler sind auf diese Weise in der Lage, sich je nach Situation immersiv im Spiel zu bewegen und die ganze Bandbreite an Körperbewegungen zu nutzen. Virtual-Reality-Erfahrungen sind jedoch nicht für alle Menschen gleichermaßen geeignet. Menschen, bei denen das dreidimensionale Sehen nicht funktioniert, können diese Technik entweder gar nicht oder nur eingeschränkt nutzen. Aber auch wenn ansonsten keine Einschränkungen bestehen, klagen einige Menschen bei bestimmten VR-Anwendungen über Übelkeit. Klassiker sind hier die virtuellen Achterbahnfahrten. Die Ursachen dieser sogenannten Motion Sickness können unterschiedlich begründet sein, werden aber oftmals schlicht durch eine schlecht programmierte VR-Anwendung ausgelöst. So tritt Motion Sickness häufig auf, wenn das Headset die wirkliche Bewegung des Spielers stark verzögert oder verfälscht in der virtuellen Realität wiedergibt. Der Körper des Nutzers bekommt in diesem Fall unterschiedliche Signale, da er sich in der echten Welt anders bewegt, als dies in der virtuellen Welt dargestellt wird. Je nach individueller Empfindlichkeit stellt sich diese Motion Sickness schneller oder langsamer ein. In solchen Fällen kann eine kurze Pause oder ein Wechsel der Anwendung helfen. Grundsätzlich ist es aber geübten VR-Enthusiasten möglich, mehrere Stunden in einem geschlossenen Headset zu verbringen. Der Mangel an Tageslicht, das Gewicht des Headsets und der Anpressdruck an das Gesicht des Nutzers trüben derzeit aber noch den Genuss besonders langer VR-Sessions. Es ist jedoch absehbar, dass sich der Komfort von entsprechenden Headsets in Zukunft so verbessern wird, dass diese unter Umständen gar unmerklich für den Träger und sein Umfeld getragen werden können.

Aber selbst wenn sich Spieler sehr geübt und ohne Motion Sickness in virtuellen Umgebungen bewegen können, zeigt sich noch oft eine vorhandene technische Begrenzung. Denn die aktuell verfügbaren Headsets sind zwar häufig in der Lage, neben der Kopf und Körperbewegung auch die Arm- und Handbewegung zu erkennen. Eine Erkennung der Beine und Füße wird jedoch meist gar nicht und, wenn überhaupt, dann nur mit zusätzlichen Sensoren unterstützt. Ein virtuelles Fußballspiel aus der Ego-Perspektive ist daher nur schwer zu bestreiten. Unmöglich ist dies jedoch nicht. Denn es befinden sich bereits Sensoranzüge auf dem Markt, die in der Lage sind, alle wichtigen Bein- und Armbewegungen zu erfassen und die Daten zu übertragen. Diese sind allerdings sehr kompliziert anzulegen, technisch noch nicht wirklich ausgereift oder teuer. Einfacher wäre es, mit weiteren zusätzlichen Einzelsensoren ein Tracking der gewünschten Bewegungsabläufe zu erfassen. Wirklich praktikabel ist aber auch das nicht. Es ist jedoch zu erwarten, dass sich in Zukunft weitere Ansätze durchsetzen werden, die ein vollständiges Bewegungstracking des ganzen Körpers ermöglichen. Diese werden vermutlich nicht nur auf verbesserter Sensorik beruhen, sondern es ist auch möglich, dass sich die Verarbeitung der eingehenden Sensordaten erheblich durch den Einsatz von künstlicher Intelligenz verbessern wird. Ein solcher Einsatz könnte es zum Beispiel ermöglichen, fehlende Sensordaten einfach dazu zu denken, nicht erfasste Bereiche aufzufüllen oder aus den Bewegungen des einen Körperteils die Bewegungen des anderen abzuleiten. Zumindest virtuelles Torwandschießen scheint mit diesen technologischen Fortschritten nicht mehr allzu weit entfernt.

Ein Anwendungsszenario, das ebenfalls heute schon gut denkbar ist, sind Mixed-Reality-Anwendungen. Die wollen wir an dieser Stelle daher etwas genauer erklären und gegenüber Virtual Reality und Augmented Reality abgrenzen. Wir verstehen Virtual-Reality-Anwendungen im engeren Sinne als solche, die ausschließlich innerhalb eines geschlossenen Headsets stattfinden, ohne dass Inhalte der echten Welt gezeigt werden. Der Träger eines VR-Headsets wird von der echten Welt also möglichst abgeschirmt. Augmented-Reality-Headsets hingegen sind nach unserer Definition offen und am ehesten mit Brillen zu vergleichen, die über durchsichtiges Glas verfügen. Das virtuelle Bild wird bei Augmented-Reality-Headsets innerhalb dieses Glases angezeigt und überlagert so bestimmte Teile der echten Welt. Der Träger wird jedoch von der echten Welt nicht isoliert. Immer dann, wenn auf den Bildschirmen oder Gläsern von Virtual- oder Augmented-Reality-Headsets die echte Welt mit einer virtuellen Schicht möglichst passgenau überlagert wird, spricht man von Mixed Reality. Bei geschlossenen Headsets wird eine Abbildung der echten Welt mithilfe von Kameras an der Vorderseite des Headsets auf den Bildschirmen im Inneren angezeigt. Hier wird dann die virtuelle Schicht auf den Bildschirmen hinzugerechnet. Bei Augmented-Reality-Headsets wird hingegen der echte Blick auf die Welt in den Gläsern der Brille mit einer virtuellen Schicht überlagert. Bei Mixed Reality reicht es aber nicht aus, einfach Informationen an die immer gleiche Stelle des Sichtfelds des Nutzers einzublenden. Vielmehr müssen für Mixed-Reality-Anwendungen beide Schichten miteinander interagieren und verschmelzen. Ein virtuell geworfener Ball muss also zum Beispiel von der echten Wand abprallen. Erst diese Passgenauigkeit der Überlagerung macht aus Virtual- und Augmented-Reality-Anwendungen eine Mixed-Reality-Erfahrung. Zur flüssigeren Lesbarkeit werden wir die Begriffe Virtual Reality, Augmented Reality und Mixed Reality im Folgenden mit VR, AR und MR abkürzen. Hin und wieder werden statt »Mixed Reality« auch Begriffe wie »Spatial Reality« und »Extended Reality« verwendet. Die Abgrenzung ist hier aber fließend und beide Begriffe deuten auf einen hohen Verschmelzungsgrad von echter und virtueller Welt hin.

Aber kommen wir nun zurück zu einem Anwendungsszenario für ein MR-Headset und betrachten ein virtuelles Paintballspiel zwischen zwei Freunden, die Mittagspause haben und deren Büro über große Flure und Flächen verfügt. Beide Spieler tragen ein geschlossenes Headset, das die echte Welt mit Kameras und Tiefensensoren live erfasst und im Inneren auf Bildschirmen darstellt, um dann eine weitere, virtuelle Schicht darüber zu legen. Mit WLAN oder einer sonstigen Netzwerkverbindung ausgestattet, könnten sich die Spieler auf dem Büroflur gegenübertreten. In den jeweiligen Headsets würde die echte Welt im Inneren dargestellt. Allerdings würden beide Spieler in ihrer Hand eine virtuelle Paintballpistole halten. Ein Druck auf den Controller würde virtuelle Farbkugeln abschießen, die mit der echten Welt interagieren, und zwar dank der erfassten Tiefeninformationen physikalisch sehr detailgetreu. Ein Spieler kann also zum Beispiel hinter dem echten Kaffeetresen in Deckung gehen, um virtuellen Geschossen zu entgehen. Das Spiel würde zudem erkennen, wenn die virtuelle Farbkugel den gegnerischen Spieler trifft und dies mit Punkten belohnen, die im Sichtfeld der Spieler eingeblendet werden. Beide Spieler wären in dieser »Multiplayer«-Partie in der Lage, sich völlig frei und ohne Begrenzungen durch den echten Raum zu bewegen. Solange die Headsets jeweils über eine Netzwerkverbindung verfügen würden, könnte das Spiel sogar nahtlos in den Außenbereich verlegt werden. Die echte Welt würde also keine Begrenzung mehr darstellen, sondern würde mit dargestellt und wäre integraler Bestandteil der Erfahrung. Nutzer könnten sich somit nur durch ihre echte Bewegung innerhalb der MR-Anwendung bewegen. Eine Bewegung per Teleportation oder Lokomotion wäre nicht mehr nötig. Zuschauer in der echten Welt würden sich derzeit vielleicht noch über die beiden Kollegen wundern, die mit Headsets auf dem Kopf durch das Büro laufen. Auf lange Sicht ist dies aber vermutlich nur eine Frage der gesellschaftlichen Akzeptanz und es kann zudem eine Rolle spielen, wie unauffällig Headsets in Zukunft sein werden – auch dazu kommen wir später noch im Detail. Hier jedoch zumindest schon einmal ein erster Vergleich: Als noch vor der Ära der Smartphones in den frühen 1990er Jahren die ersten Mobiltelefone aufkamen, war es ein äußerst ungewöhnlicher Anblick, wenn eine Person auf offener Straße telefonierte. Ein solch auffälliges Verhalten zog damals schnell die skeptische Aufmerksamkeit der Mitmenschen auf sich und es wurde die Frage gestellt, ob man wirklich immer überall erreichbar sein müsse und warum man nicht in den eigenen vier Wänden oder zur Not von Telefonzellen aus telefonieren könne. Und als Mobiltelefone moderner wurden und kleine Freisprechkopfhörer auf den Markt kamen, wunderten sich zu Beginn noch viele über ihre Mitmenschen, die vermeintliche Selbstgespräche auf offener Straße führten. Heutzutage erregt das kein Aufsehen mehr. Das Telefonieren in der Öffentlichkeit ist ein vollkommen normaler Teil unseres Alltags geworden und auch das Telefonieren über kleine In-Ear-Headsets ist mittlerweile Normalität. Teilweise sind Kopfhörer bestimmter Marken sogar zum Statussymbol oder Lifestyle-Accessoire avanciert und Mobiltelefone werden in der Öffentlichkeit schon lange nicht mehr nur zum Telefonieren genutzt. Stattdessen ist der Blick auf Smartphone-Bildschirme in fast allen Bereichen der Öffentlichkeit gegenwärtig. Menschen schauen zu allen denkbaren und undenkbaren Momenten darauf: beim Gehen auf der Straße, während des gemeinsamen Essens, im Bus, im Wartezimmer, auf der Arbeit und während sie sich mit anderen unterhalten oder bevor sie schlafen gehen. Noch verwunderlicher mag Außenstehenden vermutlich eine Person vorgekommen sein, die das im Jahr 2016 erschienene Smartphone-Spiel Pokémon GO spielte. Bei dieser MR-Anwendung für das Smartphone konnten Spieler in die Öffentlichkeit gehen und bekamen über ihre Standortinformationen und ihre Kamera eine virtuelle Spieleebene auf dem Bildschirm des Smartphones angezeigt. So war es möglich, dass sich ein sogenannter »PokéStop«, also ein Ort, an dem Spieler virtuelle Gegenstände sammeln konnten, auf einem gut besuchten öffentlichen Platz oder im Vorgarten des Nachbarn befand und nur von Personen gesehen werden konnte, die die App installiert hatten. An besonders gut gelegenen PokéStops kam es dabei gelegentlich zu einer größeren Menschenansammlung, wobei Außenstehende sich vermutlich nur wundern konnten, was all diese Menschen mit ihren Smartphones dort gerade taten. Das ging sogar so weit, dass durch die Behörden im Sommer 2016 weltweit öffentliche Plätze und exponierte Bauwerke teilweise wegen Überfüllung mit Spielern abgeriegelt werden mussten.

Die soziale Irritation, die eine Person auslöste, die in den frühen 1990er Jahren auf der Straße telefonierte, scheint heute vollständig vergessen und ist für jüngere Generationen vermutlich kaum noch nachvollziehbar. Allerdings würden sich heutzutage wohl auch die meisten Menschen in ähnlichem Maße wundern, wenn Mitmenschen die Öffentlichkeit mit MR-Headsets betreten. Insbesondere seit der Einführung des MR-Headsets von Apple, der sogenannten »Apple Vision Pro«, ist das Tragen solcher Headsets in der Öffentlichkeit schon öfter zu sehen als vorher – und vermittelt teils sogar avantgardistische Züge eines Menschen, der seiner Zeit voraus ist. Auch hier gilt: Die Zeiten ändern sich und manchmal schneller, als man glaubt. Das Tragen von MR-Headsets in der Öffentlichkeit oder in Büroumgebungen wird vermutlich in Zukunft zum ganz normalen Alltag gehören, auch wenn man sich das heute noch kaum vorstellen kann. Alle Zeichen stehen in diese Richtung, und je weiter die Technik voranschreitet, desto unauffälliger und besser werden solche Headsets in den Alltag integriert sein. Ab einem bestimmten Punkt der technischen Weiterentwicklung werden geschlossene vermutlich durch offene Headsets bzw. Brillen ersetzt, die einen MR-Blick auf die Welt erlauben, und womöglich wird es irgendwann für außenstehende Betrachter kaum noch erkennbar sein, ob jemand ein Headset trägt oder nicht. Spiele wie das beschriebene virtuelle Paintballspiel könnten dann zum Beispiel in Parks mit einer größeren Anzahl an Freunden gespielt werden. Und eine Vielzahl anderer Spiele sind darüber hinaus denkbar. Aber Spiele wären in einem solchen Szenario nur ein Teil der Anwendungen, denn die Einsatzszenarien scheinen nahezu unlimitiert.

Anwendungen für den Büroarbeitsplatz

Neben Spielen treten weitere mächtige Anwendungsszenarien in den Vordergrund. Spätestens seit der Corona-Pandemie durchdringt die Digitalisierung auch den Arbeitsalltag immer mehr. Videokonferenzmeetings und Homeoffice sind für viele Büroarbeiter mittlerweile selbstverständlich; für manche stellt dies sogar die hauptsächliche Arbeitsform dar: Selbst von unterwegs können viele Menschen mittlerweile im Rahmen der mobilen Arbeit Aufgaben erledigen und manch ein digitaler Nomade hat sich eine Arbeitsweise angeeignet, die nahezu ortsunabhängig funktioniert. Arbeit aus dem Zug, im Café, im Hotel, aus dem Parkhaus im Auto und manchmal sogar am Strand sind denkbar. VR- und MR-Anwendungen könnten hier in Zukunft wichtige Hilfsmittel darstellen. Ein noch etwas weiter in der Ferne liegendes, aber schon klar erkennbares Szenario zielt auf MR-Anwendungen ab, die tatsächlich das Potenzial haben könnten, unseren Büroalltag erheblich zu verändern, sofern die nötige Headset-Technologie in Form von offenen und durchsichtigen Brillen zur Verfügung steht. Dann nämlich könnte ein Punkt in der Zukunft denkbar sein, an dem alle anderen Bildschirme in der echten Welt überflüssig werden. In der Populärkultur wurde die Idee der vollständig virtualisierten Arbeit schon in den 1990er Jahren in Computerspielen thematisiert, so im PC-Spiel Virtual Corporation aus dem Jahr 1996, das seiner Zeit weit voraus war, indem es eine sprachgesteuerte Arbeitsumgebung im fiktiven Jahr 2028 simulierte und der Spieler das Ziel hatte, durch geschicktes zwischenmenschliches Agieren mit seinen rein virtuellen Kollegen möglichst schnell die Karriereleiter aufzusteigen.

Aber beginnen wir jenseits der Fiktion durch Computerspiele mit einem realen Beispiel anhand der Arbeitsumgebung in einem klassischen Büro oder Homeoffice. Wer im Büro über einen PC-Arbeitsplatz verfügt, hat mindestens einen Monitor auf seinem Schreibtisch. Je nach Aufgabe kommen auch gerne weitere Monitore hinzu. Browserfenster werden auf dem vorhandenen Bildschirmplatz geöffnet, verschoben und übereinandergestapelt. Videokonferenzen finden in einem dieser Fenster statt und teilweise trifft sich eine zweistellige Anzahl von Menschen und kommuniziert über eines dieser Fenster in die digitale Welt. Sofern man seinen eingerichteten Arbeitsplatz verlässt, bleibt häufig nur der Laptopbildschirm zum Arbeiten. Und selbst dann wird die Arbeit nicht selten erschwert, weil zum Beispiel Mitreisende im Zug ein Sicherheitsrisiko für die Vertraulichkeit der Daten auf dem Bildschirm darstellen oder schlicht deshalb, weil der Platz zum Arbeiten nicht ausreicht. Wie aber sähe eine Arbeitswelt aus, wenn man in Zukunft gar keinen Monitor mehr benötigen würde? Bereits das VR- und MR-Headset Oculus Quest verfügte über die Technik, die echte Welt über Kameras und Tiefensensoren zu erfassen, sie innerhalb der Brille darzustellen und computergenerierte Bilder über diese Schicht zu legen. Dieses Konzept wurde von der Apple Vision Pro aufgegriffen und verfeinert und der Weg hin zu immer mächtigeren Headsets und MR-Büroanwendungen scheint vorgegeben. Ein solches Konzept würde es uns in Zukunft tatsächlich ermöglichen, ohne klassische Monitore zu arbeiten. Stattdessen würde es ausreichen, die Welt in der Mixed Reality der Brille zu erleben. So wäre es möglich, über die Bilder der echten Welt eine virtuelle Welt zu zeichnen. Diese virtuelle Schicht könnte im Umfeld klassischer Büroanwendungen zum Beispiel die Darstellung der Fenster beinhalten, die bislang auf Monitoren angezeigt wurden. Das Fenster, in dem eine Textverarbeitung genutzt wird, könnte in beliebiger Entfernung und in beliebiger Größe im vorhandenen echten Raum virtuell platziert werden. Daneben könnten weitere Fenster, zum Beispiel Videos, Webseiten oder sonstige Dokumente zur Recherche an unterschiedlichen Orten im echten Raum virtuell abgelegt oder aufgehängt werden. Sie würden an einer beliebigen Stelle im Raum schweben und könnten ähnlich wie im Science-Fiction-Film Minority Report aus dem Jahr 2002 von einem Nutzer mit den Händen weiter bedient oder umpositioniert werden. Die Fenster könnten vielleicht sogar zusammengefasst und mitgenommen werden, wenn man seine Arbeitsumgebung verlässt, um eine Reise im Zug anzutreten – quasi so, als würde man eine Aktenmappe zu- und anschließend wieder aufklappen. Die Möglichkeiten, uns von den Fesseln starrer Monitore zu befreien, sind enorm. Wie würden Sie Ihren Büro- oder Homeofficearbeitsplatz virtuell einrichten – sofern Sie einen solchen haben? Oder an welchem Ort würden Sie mit diesen Möglichkeiten gerne arbeiten?