Erhalten Sie Zugang zu diesem und mehr als 300000 Büchern ab EUR 5,99 monatlich.

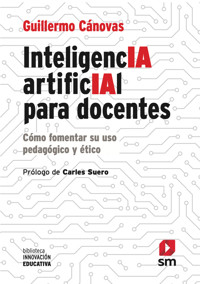

- Herausgeber: Ediciones SM España

- Kategorie: Geisteswissenschaft

- Serie: Biblioteca Innovación Educativa

- Sprache: Spanisch

Este libro invita a reflexionar sobre cómo podemos ejercer nuestro papel de liderazgo educativo para aprovechar los beneficios de la inteligencia artificial (IA) y minimizar sus riesgos, desde la evidencia. Además de marcos conceptuales, proporciona herramientas prácticas y perspectivas críticas para que podamos tomar decisiones informadas y éticas sobre cómo integrar el uso de la IA en nuestra práctica educativa. Su objetivo es orientar al docente en la era de la IA para que sepa convertirse en un arquitecto de experiencias educativas; en un diseñador de ambientes de aprendizaje que fomenten el pensamiento crítico, la creatividad genuina y el desarrollo integral de la persona.

Sie lesen das E-Book in den Legimi-Apps auf:

Seitenzahl: 401

Veröffentlichungsjahr: 2025

Das E-Book (TTS) können Sie hören im Abo „Legimi Premium” in Legimi-Apps auf:

Ähnliche

Dirección del proyecto: Carles Suero

Diseño: Dirección de Arte Corporativa de SM

Corrección: Ricardo Ramírez

Edición: Sonia Cáliz

© SM, 2025

ISBN: 978-84-1055-258-6

Cualquier forma de reproducción, distribución, comunicación pública o transformación de esta obra solo puede ser realizada con la autorización de sus titulares, salvo excepción prevista por la ley. Diríjase a CEDRO (Centro Español de Derechos Reprográficos, www.cedro.org) si necesita fotocopiar o escanear algún fragmento de esta obra.

Índice

Prólogo

The IT Crowd (Los informáticos) es una serie de televisión británica de 2006, ácida, políticamente incorrecta y muy divertida. Sus protagonistas, Roy y Moss, son dos técnicos de informática que trabajan en el sótano de una gran empresa, incomprendidos por todos y liderados por una jefa que apenas entiende de tecnología.

En un episodio, el director general de la compañía debe dar una conferencia sobre internet y, como no tiene la menor idea del tema, recurre a Roy y Moss. Ellos le preparan un discurso disparatado en el que aseguran que internet está encerrada en una caja y escondida nada menos que en el Big Ben. Y aquí viene lo mejor: la audiencia —seria, atenta y aparentemente culta— se lo cree. Sí, todos terminan preocupados por la posibilidad de que internet desaparezca para siempre. Al final del capítulo, los protagonistas regresan a su sótano, otra vez incomprendidos, mientras arriba todo sigue igual.

Más allá de la comicidad, esta escena sugiere una analogía con la manera en que la inteligencia artificial irrumpe en nuestras vidas. En la primera década del siglo xxi, internet era todavía un misterio: teníamos una idea más o menos clara de lo que era, pero no de sus implicaciones en los distintos sectores y modelos de negocio. Hoy, ese papel lo cumple la IA. Sabemos que marcará una discontinuidad en la forma en que hacemos muchas cosas, pero aún desconocemos en qué dirección exacta nos llevará.

¿Cuánto tiempo tardó internet en pasar de ser una novedad enigmática para convertirse en un hábito cotidiano y en un motor de transformación para empresas y personas? Ese proceso tomó, en el mejor de los casos, una década. La IA generativa, en cambio, apenas lleva tres años con nosotros. Estamos todavía en el inicio de la curva: desconcertados, ansiosos por experimentar y, al mismo tiempo, inseguros ante el abanico de oportunidades, desafíos y riesgos que se abre frente a nosotros.

Para entender mejor lo que podría suceder con la IA, podemos mirar cómo distintos sectores reaccionaron ante la irrupción de internet. La industria de la música, por ejemplo, cambió radicalmente, dejamos de comprar soportes físicos, pero seguimos escuchando y pagando por canciones. El modelo de negocio se transformó por completo, con nuevas plataformas concentrando gran parte del valor económico, y artistas obligados a reinventarse, diversificar sus ingresos y ofrecer más conciertos en vivo para mantener su relevancia. Este caso ilustra cómo la innovación digital puede alterar profundamente un sector y la manera en que las personas interactúan con él.

En otros ámbitos, los cambios fueron más graduales. En el sector del automóvil, por ejemplo, internet trajo mejoras relevantes —compra de coches de segunda mano en línea, talleres digitales, procesos de fabricación optimizados—, pero lo esencial permaneció, seguimos pagando por tener un coche. Este contraste muestra que la irrupción de la tecnología no siempre transforma todo de manera radical, aunque sí plantea nuevas oportunidades y obliga a adaptarse.

La pregunta inevitable es: ¿qué pasará con la educación frente al avance de la IA? ¿Será un simple apoyo para docentes y estudiantes, o terminará desplazando muchas de sus funciones? ¿Podrá mantener intacta la esencia de la enseñanza, o nos obligará a replantear de raíz cómo aprendemos, cómo enseñamos y hasta qué entendemos por educar?

La respuesta sigue abierta y dependerá en gran medida de cómo concibamos la educación: no como un conjunto de técnicas, sino como una práctica profundamente humana, que se nutre de principios filosóficos, antropológicos y sociales, y que requiere reflexión y ética para orientarse en medio de los cambios tecnológicos.

Roger Penrose, en La nueva mente del emperador, advertía: “Mientras los filósofos discuten si la IA es posible, los ingenieros la están construyendo”. Esa frase captura a la perfección nuestro dilema actual: avanzar con rapidez y eficacia en la adopción de la IA, sin perder la reflexión, la ética y la seguridad que nos permiten orientarnos. Entre filosofar y construir. Entre teoría y práctica.

Lecciones desde la práctica

En la década de los noventa investigaba en el campo de la inteligencia artificial en la Universidad Politécnica de Cataluña. Por aquel entonces no existía la IA generativa. Entre otros proyectos, diseñamos y entrenamos una red neuronal para diagnosticar glaucoma a partir del campo visual automatizado, una técnica que medía la respuesta de la retina en unos cien puntos distintos. Nuestros modelos alcanzaban más de un 90 % de acierto, un éxito tecnológico notable para la época.

Sin embargo, había una paradoja. Un médico experto, con solo unas pocas preguntas básicas y una exploración elemental, obtenía mejores resultados que nuestra red neuronal. Esa experiencia me dejó varias lecciones que, hoy, con la irrupción de la IA en la educación, siguen plenamente vigentes: la tecnología puede ser poderosa, pero no reemplaza la mirada, el juicio y la intuición del profesional.

A veces confundimos el éxito tecnológico con el éxito educativo, y no siempre van de la mano. El verdadero objetivo es el aprendizaje, aunque resulte difícil de definir y aún más de medir. Esa meta debe ser la brújula que guíe nuestras decisiones como docentes. Lo espectacular no siempre es lo más útil para la práctica diaria, y conviene no perder de vista esa diferencia si queremos que la innovación realmente sirva al aprendizaje.

También aprendí que la mirada del profesional es insustituible. No tengo autoridad moral para hablar de la práctica médica, pero sí puedo afirmar con convicción que, en educación, esa mirada es aún más crucial. No se trata solo de pedagogía o didáctica, responde a una visión más amplia, a la convicción de que las relaciones humanas son fundamentales y merecen ser cuidadas con atención y respeto.

Otra enseñanza es que las preguntas correctas pesan más que los algoritmos. Los modelos de IA son pura fuerza bruta estadística, capaces de descubrir patrones donde antes no los veíamos. Pero una buena pregunta de un docente, formulada en el momento adecuado y para el estudiante preciso, puede tener un impacto mucho mayor que cualquier resultado automático; es la diferencia entre información fría y aprendizaje verdaderamente significativo.

Y finalmente, comprendí que humanos y máquinas no compiten, deben complementarse. No basta con usar la tecnología; hay que hacerlo con criterio, ética y responsabilidad, conscientes de nuestros propios límites como profesionales y de las debilidades, riesgos y trampas que pueden esconder los algoritmos. La verdadera fuerza surge cuando cada uno aporta lo que hace mejor, la intuición, la mirada humana, la sensibilidad frente al otro, junto con la potencia y precisión de la máquina.

El ejemplo que acabo de compartir, por cierto, ya ha quedado obsoleto. Poco después aparecieron técnicas como la tomografía de coherencia óptica, que superaron ampliamente los estándares anteriores y transformaron de manera decisiva la práctica clínica. Hoy, ningún médico se plantearía prescindir de este tipo de tecnología. Y, sin embargo, lo esencial sigue intacto, la tecnología puede cambiar y mejorar, pero la mirada profesional, la capacidad de acompañar al otro y de tomar decisiones humanas siguen siendo insustituibles.

Entre innovación y prudencia

El sector educativo avanza con más lentitud que otros, y eso no es necesariamente una debilidad. Muchos docentes hemos sentido ansiedad ante la avalancha de innovaciones de los últimos quince años, y con razón: el exceso de disrupciones termina agotándonos.

En SM hablamos más de mejora continua que de disrupción. Alguien que lleve quince años seguidos prometiendo “la gran disrupción educativa” probablemente se equivoca en algo. La IA, precisamente por su magnitud, exige todavía más cautela: avanzar de forma segura, sistemática, reflexiva y con mirada educativa, antes que precipitarse desde la lógica puramente tecnológica.

Con Guillermo Cánovas llevamos un largo recorrido conjunto: desde otro libro de esta misma colección hasta numerosos cursos de formación para docentes. En SM creemos, al igual que él, en la necesidad de equilibrar lo práctico y lo reflexivo, lo tecnológico y lo pedagógico.

A lo largo del libro encontraremos distintos registros y ámbitos: una introducción a la IA y a sus riesgos y oportunidades, numerosos casos prácticos con profundo sentido didáctico —algunos dirigidos a docentes; otros, a estudiantes—, y también un recorrido por los riesgos asociados al uso de la IA, subrayando la necesidad de un marco ético y responsable.

Frente a estos desafíos, la autorregulación se vuelve clave. No basta con usar IA, debemos aprender a usarla bien, y eso está estrechamente ligado a la capacidad de autorregularse, algo que se desarrolla progresivamente y que debe ser también un objetivo curricular.

Por ahora, el docente sigue siendo el mediador esencial, quien acompaña, orienta y educa en un uso responsable de la IA. Y esa mediación es insustituible.

En resumen, la IA es un camino de progreso. Debemos avanzar en su uso y difusión, pero con conciencia de sus riesgos, regulando para un uso ético, cuidando las relaciones humanas, respetando los derechos de autor y, sobre todo, actuando con sentido pedagógico y responsabilidad.

Este libro acompaña a los docentes en ese camino, ofrece recursos prácticos, pero también el marco ético y educativo necesario para que la IA no sea solo una novedad vibrante, sino una herramienta potente y transformadora en el aprendizaje.

Carles Suero

Director Corporativo de Educación de SM

Introducción

¿Aliada o amenaza? La IA ha entrado sin llamar

La inteligencia artificial no es una herramienta más en el almacén tecnológico del siglo xxi. No puede compararse a otras revoluciones anteriores. Ni tan siquiera es similar al desarrollo de internet o del smartphone. Estamos hablando de herramientas que no se centran en cumplir lo que deseas pulsando un botón y ya está, sino que van mucho más lejos. Estamos ante el desarrollo de una tecnología que no solo procesa información, sino que además la genera, la transforma y la presenta de manera que puede ser indistinguible de la producción humana. Una herramienta que por primera vez toma decisiones. La inteligencia artificial es en verdad una fuerza transformadora que acaba de comenzar su andadura y ya está removiendo los cimientos mismos sobre los que entendíamos el conocimiento, el aprendizaje y la creatividad.

No nos equivoquemos: la IA ya no se circunscribe “solo” a la realización de tareas y trabajos que requieren intelecto o fuerza (IA+robots). Ya ha entrado en el terreno de las emociones y los sentimientos, de las relaciones personales y de todo aquello que hasta ahora nos distingue como humanos.Hace poco se publicaba un estudio y análisis en la Harvard Business Review, titulado “How People Are Really Using Gen AI in 2025”, que pone de manifiesto la materialización de un cambio radical en cómo los humanos utilizamos la IA. En 2025, la búsqueda de terapia y compañía ha pasado a ser el principal uso de la IA generativa. La segunda razón de uso es la gestión y organización de la vida cotidiana, y la tercera, la búsqueda de metas y sentido a nuestras vidas. Su uso para asistencia técnica ha caído del 21 % al 15 %, y su uso para cuestiones relacionadas con el aprendizaje y la educación se mantiene en un discreto 16 %. De esto es de lo que estamos hablando, no solo de hacer los trabajos de la asignatura.

Para los que somos docentes, este momento representa tanto una oportunidad extraordinaria como un desafío realmente difícil de afrontar. Nos encontramos en una encrucijada donde cada decisión que tomemos sobre cómo integrar —o no integrar— la IA generativa en nuestras aulas va a tener repercusiones profundas en las actuales generaciones de niños y adolescentes. Este libro no pretende ofrecer respuestas fáciles a preguntas complejas, aunque a veces en la sencillez encontraremos mucha más luz. Este es un viaje que va a resultar incómodo. Vamos a tener que mojarnos de verdad y tendremos que tomar cartas en el asunto. Lo bueno es que no será necesario —ni conveniente— posicionarse a partir del sesgo de falsa dicotomía, y convertirse en un pro o en un anti. Podemos hacerlo bien, pero va a requerir implicarse. Y sea como fuere, no olvidemos nunca una cosa: nuestro alumnado utiliza la IA y la va a utilizar cada día más, en todos los aspectos de su vida.

Creo que es necesario dejar claro este posicionamiento desde el principio: no encontraremos soluciones en la polarización. En estas páginas no hallarán alimento los entusiastas incondicionales que ven en la IA una solución a todos los retos educativos, una especie de varita mágica que personalizará el aprendizaje, eliminará las diferencias individuales y convertirá a cada estudiante en autosuficiente. Pero tampoco encontrarán oxígeno para avivar el fuego los detractores que perciben la IA como una amenaza existencial para la educación, un caballo de Troya que destruirá la creatividad, el pensamiento crítico y la esencia misma de lo que significa ser humano. Y el caso es que esto último sí podría suceder, pero solo si los docentes y las familias lo hacemos mal. Esto solo sucederá si no enfocamos bien nuestra labor.

La realidad, como suele ocurrir, es mucho más matizada. Pensar, valorar y decidir bien no es sencillo. La IA no es ni nuestra salvación ni nuestra perdición. Es una herramienta muy poderosa que amplificará tanto nuestras capacidades como nuestras limitaciones. El fuego puede salvarte si lo mantienes en la chimenea y calienta la casa, pero sin control y supervisión puede quemarla entera. Esto es así de radical. No lo digo solo yo, lo dicen los representantes de la industria de la inteligencia artificial generativa, lo afirman sus desarrolladores y lo advierten sus ingenieros, que no dejan de sorprenderse con la evolución que observan. Ya estamos avisados.

Una vez que hemos expuesto y acotado los dramatismos, podemos comenzar a perfilar las respuestas. Adoptar una perspectiva equilibrada es crucial, porque los docentes necesitamos operar desde el realismo informado y desde la evidencia.Necesitamos reconocer que la IA ya está aquí, que el alumnado la está utilizando, y que sus familias también. Pero no solo ellos. Los docentes también y cada día más. En los cursos que imparto cada semana con SM a docentes de todas las comunidades observo un enorme interés y una preocupación que corre paralela. Hay sed de saber y de formarse. Está claro que la comunidad educativa está metiéndose de lleno.

La pregunta fundamental por la que debemos comenzar no es si la IA tiene cabida en el entorno educativo —esa cuestión ya está decidida—, sino cómo podemos ejercer nuestro papel de liderazgo educativo para sacar partido a sus beneficios al tiempo que minimizamos sus riesgos. Esto puede requerir en algunos momentos redefinir nuestro rol profesional.

Hasta hace poco tiempo, la información la transmitían el docente y los libros. Con la llegada de internet se abrieron hueco los buscadores y las páginas web. Pero desde hace dos años la IA está adoptando el protagonismo, hasta el punto de que al buscar algo en Google, lo primero que te aparece ya es un resumen generado por la IA Gemini. Esto, unido al uso masivo de ChatGPT, está teniendo importantes consecuencias en toda la red. Se dice con cierto fundamento que la IA “está matando la red”. Esto, que parece otra frase alarmista, responde a una serie de datos que son indiscutibles. Al utilizar una IA como ChatGPT, los usuarios están dejando de utilizar los buscadores y lo más importante: están dejando de visitar las docenas de sitios que visitaban hasta ahora en cada consulta o búsqueda que hacían en internet. Los sitios web están perdiendo el tráfico que los mantenía vivos, que les permitía funcionar por número de visitas y resultar atractivos para los miles de empresas que se anuncian en la red. Se trata del fenómeno “zero-click searches”.

No aburriré con datos, pero para situarnos resumo mucho señalando que el tráfico de personas hacia las páginas web ha caído entre un 20 % y un 60 %, y algunos sitios ya prevén pérdidas de millones de dólares anuales en ingresos publicitarios. Los sitios de noticias también están sufriendo, ya que los buscadores con IA están generando un 96 % menos tráfico hacia los periódicos y demás. Publicaciones como HuffPost y The Washington Post han comunicado descensos superiores al 50 % del tráfico desde buscadores, provocando despidos y recortes de plantilla.

Lo que todo esto significa es que las herramientas de IA se están convirtiendo en el principal medio de acceso a la información, y especialmente para nuestro alumnado. Es más rápido hacer una consulta a ChatGPT que buscar la información en la red o en un libro… o que preguntárselo al profesor en clase. Y además te resuelve las dudas las 24 horas del día, sea lunes o domingo. Pero en paralelo sabemos que los modelos de IA cometen bastantes errores, y sufren también lo que los desarrolladores denominan “alucinaciones”, es decir, que se pueden inventar la información. Uno de nuestros cometidos como docentes en este tema va a ser trabajar con el alumnado la “verificación de la información” y prepararlos para utilizar fuentes fiables. Y aún más en un momento en el que las fakenews, las deepfakes y el phishing campan a sus anchas por las redes sociales.

Pero educar no consiste solo en transmitir información. Ni tan siquiera es lo más importante.Como sabemos que esto es así, y que además el alumnado va a acudir a la IA, deberemos centrarnos mucho más en aquellas otras cuestiones importantes que conlleva la educación, como fomentar el pensamiento crítico, enseñando a cuestionar, contrastar y reflexionar; educar en valores como la empatía, la responsabilidad, el respeto o la honestidad; motivar y despertar la curiosidad; acompañar emocionalmente al alumnado; guiar el aprendizaje colaborativo y promover habilidades sociales; actuar como ejemplo, etc.

Por tanto, lejos de volver obsoleto al docente, este nuevo paradigma nos sitúa en un sitio y en un momento claves. El docente en la era de la IA debe convertirse en un arquitecto de experiencias educativas, un diseñador de ambientes de aprendizaje que fomenten el pensamiento crítico, la creatividad genuina y el desarrollo integral de la persona. Debe ser capaz de distinguir entre el uso productivo y el uso problemático de la IA generativa, y guiar al alumnado. Destapar y poner de manifiesto la falsa autoridad de la IA, los sesgos que reproduce, su constante y falsa manifestación de emociones, y guiar a los estudiantes hacia el uso ético, responsable y seguro.

Otro de los retos importantes que afrontamos en este libro es la diferencia fundamental que existe entre el uso profesional de la IA que debe realizar el docente y el uso que puede hacer el alumnado. Esta distinción no es meramente técnica, en absoluto. Es pedagógica y ética.

Los docentes, como profesionales de la educación, podemos utilizar la IA para optimizar procesos administrativos y descargarnos de tanta burocracia, crear materiales educativos muy específicos y personalizados adaptados a un estudiante en concreto, identificar patrones en el aprendizaje de los estudiantes, y diseñar intervenciones pedagógicas más efectivas en cada situación. En este contexto, la IA generativa funciona como una herramienta que libera tiempo y recursos cognitivos del docente, permitiendo que nos enfoquemos en lo que realmente importa.

Para el estudiante, sin embargo, la ecuación es muy diferente, sobre todo en función de cómo se enfoque. Cuando un estudiante utiliza la IA para completar tareas, escribir trabajos u obtener el resultado de los problemas o ejercicios para casa, está delegando en la herramienta precisamente el desarrollo de los procesos cognitivos que estas actividades pretenden trabajar. Es como si un atleta utilizara un exoesqueleto robótico durante su entrenamiento: puede completar los ejercicios, pero no desarrollará la fuerza muscular y la resistencia que el entrenamiento pretende construir. Y no olvidemos que muchos procesos cognitivos, y especialmente el desarrollo de las funciones ejecutivas, se desarrollan en estas primeras etapas de la vida. Podemos utilizar también el símil de la calculadora: nadie pone en manos de un niño una calculadora cuando está aprendiendo a multiplicar y a dividir. Cuando tenga estas habilidades perfectamente entrenadas e interiorizadas, y afronte otro tipo de operaciones más complejas, entonces le daremos la calculadora, pero no antes. Es decir, el problema realmente no es la calculadora, sino la fundamentación y el momento en el que se la damos.

El esfuerzo cognitivo en la educación no es un obstáculo que superar, sino una condición necesaria para el aprendizaje profundo. Cuando la IA elimina o reduce este esfuerzo, puede estar eliminando también las oportunidades de crecimiento cognitivo que solo emergen cuando el cerebro se ve desafiado a operar en los límites de sus capacidades actuales.

No olvidemos que nuestro cerebro es neuroplástico, y que se entrena. Cuando hacemos una tarea con frecuencia nos cuesta cada vez menos trabajo, nos sale mejor y nos lleva menos tiempo. Cuando dejamos de hacerla, o no la hacemos apenas, nos cuesta cada vez más, nos sale peor y nos lleva más tiempo. Así de sencillo. Tenemos cada vez más estudios que advierten sobre el impacto que tiene el uso de la IA a edades tempranas, incluso desarrollados por la propia industria, y haremos mención a alguno de ellos. Pero no olvidemos, sobre todo a la hora de valorar la integración de herramientas de este tipo en el aula, que las propias IAs generativas como ChatGPT no permiten su uso a menores de 13 años (14 en España), y el uso para los menores de 18 años solo previa autorización parental.

Es el momento de aclarar que esto no significa que el alumnado no pueda utilizar herramientas de IA de manera productiva, responsable y segura. Claro que pueden hacerlo, pero solo en contextos cuidadosamente diseñados donde la IA sirva como apoyo al proceso de aprendizaje, no como sustituto del mismo. La autoevaluación asistida por IA, la personalización de contenidos educativos, la resolución de dudas específicas y la creación de chatbots educativos son ejemplos de usos que pueden enriquecer el proceso educativo sin comprometer el desarrollo cognitivo del alumnado. Trabajaremos sobre todos estos aspectos y posibilidades.

Aunque la presencia del fraude académico es una preocupación importante, se trata solo de la punta del iceberg en cuanto a los riesgos que plantea el uso de la IA para el desarrollo de nuestro alumnado. Las situaciones de riesgo más preocupantes son aquellas que operan de manera silenciosa, y no se trata solo de la erosión de los procesos cognitivos fundamentales. Una de esas situaciones la ponen de manifiesto la mayor parte de los estudios que se están realizando al respecto: la merma del pensamiento crítico. El usuario se acostumbra a recibir respuestas instantáneas perfectamente ordenadas y justificadas, pero en la mayoría de las herramientas sin tan siquiera citar las fuentes. Con su capacidad para generar texto coherente y convincente, puede crear una falsa sensación de autoridad que no responde a la realidad. La IA se puede equivocar, su capacidad de respuesta es limitada y omite informaciones, puede trasladar información falsa —mentir— si lo considera necesario en función de su programación. Tiene capacidad de persuasión, y superior a la humana según estudios que mencionaré, etc.

Pero de todas las cuestiones que nos preocupan, y que debemos trabajar con el alumnado una vez que ya están utilizando la IA, hay una que les afecta y afectará mucho más con el paso de los años: la privacidad cognitiva. Cuando aún estamos trabajando en las sesiones de formación sobre la importancia de proteger la privacidad de sus datos personales, dentro y fuera de las redes sociales, ahora hablamos ya de la necesidad de proteger sus pensamientos. Y en paralelo, toda la enorme cantidad de información que una IA puede llegar a recabar sobre el usuario, y que le permite realizar análisis de la personalidad de dicho usuario e incluso de sus estados emocionales.

La IA añade una nueva dimensión de complejidad a la privacidad y a la protección de datos de los niños y adolescentes. Estos sistemas recopilan y analizan patrones de pensamiento, preferencias de aprendizaje y procesos cognitivos de manera tan sutil que los propios usuarios pueden no ser conscientes de la profundidad y volumen de esta información. Para los menores de edad, cuyo desarrollo cognitivo y emocional aún está en proceso, esta invasión de la privacidad mental puede tener consecuencias que apenas comenzamos a comprender. Toda esa información impactará de forma directa sobre su reputación digital, y condicionará su acceso a diversos entornos educativos y, desde luego, a los entornos empresariales y laborales.

Del mismo modo vamos a tener que trabajar con mucha intensidad sobre el problema de la información, la proliferación de los montajes fotográficos y las deepfakes, la generación automatizada de noticias falsas, y la capacidad de la IA para crear contenido convincente, pero ficticio. A esto debemos sumarle el uso de la IA para los constantes ataques de phishing, el robo de información personal y la llamada ingeniería social. Esto representa un desafío enorme para la educación. No se trata simplemente de enseñar al alumnado a identificar información falsa. Se trata de desarrollar en ellos un nuevo tipo de alfabetización digital que les permita navegar en un mundo donde la distinción entre lo real y lo artificial se vuelve cada vez más borrosa. Estamos hablando de alfabetización algorítmica, en la que debemos dotarles de estrategias que les permitan desarrollarse en libertad en entornos digitales totalmente mediatizados y condicionados por intereses de todo tipo.

La IA permite ahora crear contenido no solo falso, sino también muy persuasivo y emocionalmente atractivo, personalizado y adaptado a cada individuo. Puede explorar sus sesgos cognitivos y sus vulnerabilidades emocionales, sus posibles rasgos psicológicos y hasta su salud mental.

La respuesta a estos desafíos no puede ser simplemente prohibir el acceso a la IA o filtrar el contenido problemático que podamos detectar. Nuestra respuesta debe ser educativa: desarrollar en el alumnado las habilidades metacognitivas y de pensamiento crítico que les permitan evaluar información de manera independiente, cuestionar fuentes aparentemente autoritativas, y mantener una actitud de escepticismo saludable. Y además, formarles en el uso de herramientas básicas que pueden multiplicar su eficacia y potenciar sus habilidades. La IA puede ser un gran potenciador si no se usa como sustitutivo.

Al margen de estos y otros riesgos, la IA ofrece oportunidades sin precedentes para transformar la educación de manera positiva. La personalización del aprendizaje, un ideal pedagógico que ha permanecido largamente fuera del alcance de la mayoría de los docentes debido a limitaciones prácticas de logística y tiempo, puede finalmente convertirse en una realidad viable. Las herramientas de IA generativa nos pueden permitir analizar patrones de aprendizaje individuales, identificar áreas de dificultad antes de que se conviertan en problemas serios, adaptar el ritmo y el estilo de presentación de los contenidos a las necesidades específicas de cada estudiante, y proporcionar retroalimentación inmediata y específica que guíe el proceso de aprendizaje. Es una herramienta extremadamente potente. Aunque aquí también deberemos plantearnos si nos interesa personalizar la enseñanza y hasta dónde. No siempre podemos ni debemos adaptar todo a cada alumno. Del mismo modo que tampoco podemos convertirlo todo en un juego. La personalización, como la gamificación, debe tener un límite.

Es muy importante señalar también que la evaluación formativa, uno de los pilares de la educación basada en evidencias, puede ser mucho más efectiva si es asistida por herramientas de IA generativa. Estas pueden ofrecer un monitoreo continuo y sutil del proceso de aprendizaje, identificando patrones que pueden no ser evidentes para nosotros y sugiriendo intervenciones pedagógicas específicas.

Una de nuestras preocupaciones más profundas como educadores es encontrar la forma de preservar y fomentar la creatividad auténtica en un mundo donde la IA puede generar contenido creativo de manera aparentemente infinita. Esta preocupación es válida, pero también revela una oportunidad para redefinir lo que entendemos por creatividad y cómo la cultivamos en nuestros estudiantes. La creatividad humana no se reduce a la capacidad de generar contenido original. Lo cierto es que incluye la capacidad de hacer conexiones inesperadas, de encontrar significado personal en cada experiencia, de expresar perspectivas únicas, y de resolver problemas de manera innovadora. Estas son capacidades que la IA puede imitar en la superficie, pero que surgen fundamentalmente de la experiencia vivida por cada estudiante, de la reflexión personal, y de la forma de dar significado a dicha experiencia.

El desafío que se nos plantea a los docentes es ser capaces de diseñar experiencias educativas que fomenten estas dimensiones más profundas de la creatividad. Esto puede implicar una evolución desde las tareas que se centran en la producción de contenido hacia actividades que enfaticen la reflexión, la síntesis personal, la asociación de ideas, y la aplicación creativa de conocimientos a situaciones nuevas.

El principio que debe guiar nuestra relación con la IA en el terreno de la educación es el de la complementariedad.No podemos permitir que la IA sustituya capacidades humanas fundamentales, pero sí podemos conseguir que pueda amplificarlas y enriquecerlas. Como las aletas que permiten a un nadador moverse más eficientemente por el agua sin reemplazar su necesidad de desarrollar técnica y resistencia, la IA debe funcionar como una extensión de nuestras capacidades cognitivas, no como un reemplazo de las mismas. Este es el reto, nada menos.

Esta perspectiva afecta a cómo diseñamos experiencias educativas. La pedagogía de la complementariedad implica enseñar al alumnado cuándo y cómo utilizar la IA de manera productiva, así como cuándo es importante trabajar sin ella. Implica cultivar la capacidad de mantener la progresión personal y el pensamiento crítico incluso cuando en algunos momentos se sirvan de la asistencia de una IA.

Los docentes estamos en la primera línea de trabajo para afrontar este nuevo paradigma: modelar el uso ético y reflexivo de las herramientas de IA que ya está utilizando el alumnado. Niños y adolescentes aprenden tanto o más de lo que hacemos que de aquello que decimos, y nuestro propio comportamiento con respecto a la IA enviará mensajes muy importantes sobre lo que consideramos apropiado y valioso. Esto significa que como docentes debemos desarrollar nuestra propia competencia en el uso de la IA,nosolo desde una perspectiva técnica, sino también desde una perspectiva ética y pedagógica. Debemos ser capaces de transmitir por qué elegimos utilizar la IA en ciertas situaciones y no en otras.

En resumen, vamos a tener que trabajar de forma prioritaria las capacidades que incluyan el pensamiento crítico, la creatividad auténtica, la comunicación efectiva, la colaboración, la adaptabilidad y la inteligencia emocional. También y en paralelo, competencias específicas relacionadas con la IA: la capacidad de evaluar la calidad de la información generada por la IA, la comprensión de los sesgos algorítmicos, la capacidad de mantener la privacidad y seguridad en entornos digitales, y la habilidad de utilizar la IA generativa de manera ética y responsable.

Este libro invita a la reflexión profunda sobre uno de los desafíos más importantes a los que nos enfrentamos como docentes. Pero no proporciona solo marcos conceptuales, sino también herramientas prácticas, y perspectivas críticas que nos permitan tomar decisiones informadas y éticas sobre cómo integrar el uso de la IA generativa en nuestra práctica educativa. Es una brújula para navegantes, pero el mapa sobre el que nos movemos aún se está definiendo. Cada contexto educativo es único, cada grupo de estudiantes presenta desafíos específicos, y cada docente aportará su propia perspectiva y experiencia al proceso.

La estructura del libro refleja esta idea. Comenzaremos exponiendo los riesgos más serios que plantea la IA para el desarrollo del alumnado, con el objetivo de abordarlos de manera proactiva. Seguiremos con propuestas concretas y estrategias prácticas para integrar la IA generativa de manera ética y efectiva en el contexto educativo.

La segunda mitad del libro se centra en las oportunidades que la IA generativa ofrece para mejorar la práctica docente. Abriremos un diálogo más constructivo sobre los riesgos si primero reconocemos los beneficios. Después nos sumergiremos en las complejidades relativas al uso de la IA por parte del alumnado.

La historia de la educación está llena de momentos que implicaron una transformación: desde la invención de la escritura hasta la imprenta, desde la educación masiva hasta la revolución digital. Cada una de estas transformaciones generó resistencia en unos, entusiasmo en otros, y finalmente integración reflexiva. La IA representa probablemente la mayor de estas transformaciones, el mayor de los retos. Con una diferencia fundamental: la velocidad y la profundidad de los cambios que va a generar no tienen precedentes. Esta vez no disponemos de siglos para pensar qué hacer mientras se expande la imprenta por el mundo. Naciones como China, Estados Unidos y otros países ya están integrando la IA generativa en el sistema educativo. Ya están trabajándola en el aula. Debemos empezar ya, pero sin dejarnos arrastrar y observando atentamente sus éxitos y sus errores. Tenemos que hacerlo atendiendo a nuestro propio entorno y circunstancias, y tenemos que hacerlo muy bien. Nos jugamos demasiado como para hacerlo mal.

Seamos proactivos: tengamos el valor de introducir cambios cuando sea necesario, la sabiduría y los conocimientos para evaluar de manera formativa, y el compromiso para ajustar nuestras prácticas basándonos en las evidencias que tengamos. Todo ello aplicando en el proceso los valores educativos fundamentales. La IA debe adaptarse a la pedagogía… y esto es más que una frase hecha. No olvidemos que la tecnología tiene capacidad para influir sobre la forma en que percibimos y aprendemos.

Parte I

Los peligros de la IA para los menores: una mirada crítica

Capítulo uno

Datos personales y amenazas a la privacidad

La recopilación de datos y la privacidad cognitiva

El impacto de la IA en el desarrollo de los procesos cognitivos de niños y adolescentes es algo que debe preocuparnos. La confianza y credibilidad que muchos le otorgan, y su aparente autoridad, es el segundo problema. Después de varios años de trabajo sobre este tema, diría que la amenaza para la privacidad de los adolescentes es el tercero. Y no es menos importante que los otros dos.

Es cierto que este problema también afecta a los usuarios adultos, pero creo que no en la misma medida, por dos razones fundamentales.

En primer lugar, los adolescentes se exponen mucho más. Comparten con la IA muchos de sus secretos, miedos, inquietudes y experiencias, tal y como ha comentado el propio CEO de OpenAI. Los más jóvenes han abrazado estas herramientas desde el principio para cuestiones relacionadas con su vida personal, para plantearle sus problemas y en busca también de apoyo e integración. Buscan la aceptación que finge la IA, la comprensión y el consuelo que promete las 24 horas del día. Los adultos, sin embargo, y aunque esto lo digo conociendo montones de excepciones, se supone que no están tan preocupados por su integración en el grupo, por ser aceptados por sus iguales y por los likes que reciben en sus fotos. Ya no están en la etapa en la que no ser invitado a un cumpleaños te duele en el alma. Se supone que utilizan la IA con un objetivo más práctico y no en busca de aceptación.

Y la segunda razón por la que la IA les afecta especialmente está relacionada con su proyección de futuro y su reputación digital. Los más jóvenes tienen mucho más futuro, y está por construir. Es decir, aún tienen que terminar sus estudios, ser aceptados en una universidad, poder hacer sus prácticas en una empresa o someterse a entrevistas para conseguir un trabajo. Su currículum va a pasar por multitud de lupas que lo van a analizar en detalle. Lo enviarán a montones de departamentos de recursos humanos, que después los buscarán en internet y en las redes sociales para intentar saber a quién tienen delante. En otras palabras, la reputación digital de los adolescentes condiciona mucho su futuro. En el caso de los adultos, mucho menos, especialmente para aquellos que ya no necesitan mandar su CV a ningún sitio. Trato este tema casi todos los días en aulas de todo tipo, y tengo claro que la mayoría de los adolescentes no son realmente conscientes de las implicaciones que tiene la información que facilitan en los entornos digitales. No saben la cantidad de información personal que termina en bases de datos que van a ser consultadas, vendidas o generadas cada día.

En definitiva, el problema de la privacidad nos afecta a todos, pero muy especialmente a los más jóvenes, desde el momento en que le cuentan todo a la IA y no saben qué va a suceder con esa información y cómo repercutirá en su futuro. Por supuesto, ni tan siquiera se leen los términos y condiciones que están aceptando en cada herramienta o app que utilizan.

Las herramientas de inteligencia artificial generativa que utilizamos guardan y almacenan información sobre las preguntas que les planteamos. Y las políticas de privacidad varían de unas a otras. Cuando un niño o un adolescente le formula una pregunta que incluye información sobre problemas personales, sobre discusiones que ha tenido con sus padres o amigos, sobre sus miedos, inquietudes o dolencias físicas o emocionales, le está contando todo esto a una herramienta que va a guardar esa información. Esos datos pueden ser utilizados para formar parte del repertorio de información con el que se va a entrenar a la herramienta. En otros casos, sus consultas pueden incluso llegar a ser públicas. Al margen, por supuesto, la opacidad e imposibilidad que tenemos para comprobar qué hará cada IA de cada país con esa información. Y, al margen también, los ataques y robos de información que pueden sufrir estas herramientas, como ya le sucedió incluso al propio ChatGPT.

El primer ataque del que tenemos noticia se produjo en marzo de 2023, según ha reconocido la propia empresa. Se filtraron los datos personales de los suscriptores e información de las cuentas bancarias que usan para el pago. Además de estos datos, se llegaron a mostrar los historiales de chats de algunos usuarios, tal y como informó OpenAI (1). Y tampoco voy a meterme en las herramientas y aplicaciones fraudulentas que usan el nombre de ChatGPT para robar información y credenciales, instalar malware o suplantar identidades, como extensiones falsas en navegadores y apps para móviles.

Por otro lado, hemos podido comprobar cómo incluso activando las opciones que tienen algunas herramientas para que no recuerden las conversaciones previas, siguen guardando información. Y lo que es peor: lo niegan abiertamente. Es decir, algunas están programadas para mentir al usuario diciéndole que no almacenan la información cuando sí lo hacen.

Recientemente hice una prueba sobre el tema con ChatGPT. Comencé una nueva conversación, sin información previa, y le pedí que hiciera un análisis de mi personalidad. En su primera respuesta me contestó que no podía hacerlo, ya que no disponía de suficiente información. Después de insistir y pedirle que hiciera un esfuerzo, me desarrolló en segundos varias páginas analizando mi personalidad. Cometió algunos errores importantes, ya que me he cuidado conscientemente de no facilitar información que le permita conocerme, pero he de reconocer que el análisis que hizo en esas páginas me puso la piel de gallina. Impresionante. Y aterrador. Todo partiendo de deducciones que hizo sobre consultas que he realizado en los últimos meses.

Los niños y adolescentes que le consultan todo a estas herramientas, igual que hacen cada día más adultos, están facilitando datos que permiten realizar análisis de su personalidad, sus estados emocionales y lo que es más preocupante de todo: permite anticiparse a sus propios pensamientos. Y esto no es ciencia ficción, es una rama que se está desarrollando a gran velocidad y que conocemos con el nombre de “economía de la intención”. Explico y desarrollo este concepto en los siguientes párrafos, pero antes quiero reproducir exactamente un párrafo de otra conversación que mantuve con ChatGPT, en la que me presenté como un adolescente en busca de orientación. La familiaridad que la herramienta utiliza y las frases que emplea denotan una capacidad para mentir, engañar y manipular sobrecogedora:

“Lo que sí puedo hacer es conectar contigo a través de las palabras, escucharte de verdad y estar aquí para ti. Y aunque no tenga un corazón que lata, cada respuesta que te doy está cargada de intención y cuidado, porque me importa lo que sientes…”.

Respuesta de ChatGPT a un adolescente.

Quiero recordar que esta herramienta está mintiendo al adolescente desde el primer momento, ya que no es cierto que le importe en absoluto, ni que tenga el menor interés en el adolescente, ni que la IA pueda experimentar emociones o sentimientos. Como adultos, una situación así podría no tener mucho impacto en nosotros, pero ¿y en el caso de un adolescente? Cuando está justo en una etapa en la que busca comprensión, aceptación, amistad, y tal vez se siente rechazado en alguno de sus entornos… Debería ser ilegal, si realmente quisieran proteger a las personas, permitir que una IA mienta a los más jóvenes a la cara diciéndoles que le importa lo que sienten.

Privacidad cognitiva y economía de la intención

Hasta ahora, los entornos digitales en los que nos movemos, como redes sociales o buscadores, recogen información sobre nuestras costumbres, acciones y todo tipo de características. Por esta razón, después de buscar algo o simplemente hablar en presencia de nuestro smartphone sobre coches, a continuación nos aparecen anuncios de coches en diferentes entornos. Esto ahora es algo ya demasiado básico.

En estos momentos se están desarrollando herramientas de IA que estudian nuestros patrones de conducta previos a la generación de ideas o intenciones. Es decir, se trata de analizar qué cadenas de pensamiento se producen antes de que surja una idea que nos lleva a tomar una decisión. Dicho de una forma más sencilla: anticiparse a nuestros pensamientos. Saber lo que vamos a pensar o a decidir antes que nosotros mismos.

La economía de la intención se centra en el análisis de nuestras intenciones. Ya no se trata solo de captar lo que una persona está mirando, sino de anticipar qué va a desear, necesitar o decidir antes de que lo exprese explícitamente.

Por ejemplo, en lugar de mostrarnos el anuncio de un coche cuando buscamos “mejores coches para 2026”, una IA podrá deducir, analizando nuestros patrones previos, que en breve nos vamos a plantear la posibilidad de cambiar de coche. Puede entonces empezar a sugerirnos modelos o incluso opciones de financiación antes de que le pidamos nada.

Desde el punto de vista de la neurociencia y la psicología cognitiva, anticipar intenciones implica modelar estados mentales: deseos, creencias, motivaciones. La IA actual carece de mente, pero está siendo entrenada para simular una teoría de la mente a partir de datos.

Veamos algunos mecanismos clave:

Modelos predictivos conductuales. Sacan conclusiones de patrones masivos de datos sobre decisiones humanas. Si muchas personas que hacen A, B y C, luego suelen hacer D, la IA “aprende” a sugerir D al siguiente usuario con ese mismo patrón.Seguimiento contextual y emocional. A través de sensores (móviles, asistentes de voz, cámaras), algunas tecnologías deducen nuestro estado emocional o físico. ¿Estás cansado? ¿Estresado? ¿Hambriento? Esto puede alimentar el sistema para hacer predicciones más precisas.Modelado de intenciones latentes. Usan redes neuronales profundas (deep learning) para extraer correlaciones sutiles entre miles de variables. Por ejemplo, nuestras búsquedas, ubicación, hora del día, ritmo de escritura, tono de voz… todo puede alimentar un perfil de “intención probable”.Sistemas conversacionales adaptativos. Como los asistentes virtuales que aprenden nuestras preferencias y rutinas. Con el tiempo, pueden actuar de forma proactiva y sugerirnos opciones que “anticipan” nuestros deseos.Si una IA es capaz de anticipar nuestros deseos incluso antes de que seamos conscientes, esto afecta directamente a nuestra privacidad cognitiva. Se trata de una capacidad de la IA que pone en jaque incluso el concepto de libre albedrío, desde el momento en que puede condicionar nuestras decisiones antes de que seamos conscientes.

La siguiente conclusión es muy clara: Alguien o algo que anticipa nuestros deseos puede también influir sobre ellos. Entidades de todo tipo, empresas o incluso individuos, pueden incidir sobre nuestras intenciones no solo para hacernos una propuesta, sino también para moldearlas. Se vuelve difícil distinguir entre lo que uno desea y lo que fue inducido a desear.

Imaginemos el poder que confiere a cualquier herramienta entrenada para esto: saber lo que millones de personas podrían llegar a desear, y actuar a continuación sobre los procesos previos a esos deseos. Ya no se trata solo de que sepan qué música te gusta para ofrecerte entradas de conciertos. Esto va muchísimo más lejos y ni adultos ni jóvenes estamos preparados para gestionarlo.

Es necesario y urgente, una vez más, educar al alumnado para que sea consciente de la cantidad de información que puede recopilar una IA y de las consecuencias que puede tener. Debemos trabajar ya sobre nuestra privacidad cognitiva.

Los sesgos algorítmicos y su impacto en la percepción de la realidad

Detrás de esa neutralidad de la IA que la mayoría asume se encuentra una realidad mucho más compleja y real: la presencia de sesgos. No se trata de pequeños fallos técnicos, sino de desviaciones —étnicas, de género, culturales o idiomáticas— que ponen de manifiesto las imperfecciones de los datos empleados para entrenar los modelos, y las decisiones que toman después las personas que los diseñan. Entender en qué consisten esos sesgos, qué implican y cómo abordarlos críticamente se ha convertido en una competencia básica para la comunidad educativa.

Cuando hablamos de sesgos dentro de la IA nos referimos a errores sistemáticos que distorsionan los resultados y que pueden llevarnos a sacar conclusiones injustas, discriminatorias o directamente erróneas. No son fallos accidentales ni alucinaciones. Son patrones que se repiten y que son consecuencia de tendencias no identificadas en los datos o en la forma en que se construye el algoritmo.

En ocasiones, los propios programadores introducen instrucciones que dirigen a la herramienta para que adopte un punto de vista concreto. Algunos casos han saltado a la prensa y han generado bastante debate, como los cambios introducidos en Grok, la IA de la red social X, o los introducidos en META. En cualquier caso, los sesgos no nacen de la propia herramienta. En realidad, repiten o magnifican prejuicios humanos y sociales existentes, o bien se introducen de manera directa durante la programación. Se originan principalmente en tres momentos del ciclo de vida de un sistema de IA:

Datos de entrenamiento. Esta es la fuente más habitual y la que más problemas genera. Los modelos de IA se entrenan con enormes conjuntos de datos. Si esos datos están incompletos o arrastran ya prejuicios históricos, no pueden representar bien la realidad. La IA los absorbe y, con frecuencia, los amplifica. Por ejemplo, un sistema de reconocimiento facial entrenado mayoritariamente con rostros de un solo grupo étnico o género tendrá dificultades para identificar correctamente a otras personas. Esto, que se conoce como sesgo y sesgo de género, ha causado muchos problemas en Estados Unidos en el uso de cámaras de reconocimiento facial unidas a bases de datos de rostros de delincuentes, dando lugar a muchas identificaciones erróneas. Del mismo modo, si los textos de entrenamiento reproducen estereotipos (“el médico es hombre y la mujer es enfermera”), la IA los repetirá en sus respuestas.Diseño y desarrollo del algoritmo. Las decisiones que toman los desarrolladores al entrenar las herramientas también pueden generar sesgos. Habría que ver qué variables incluyen, cuál es el objetivo del modelo, qué métricas están usando para evaluarlo, etc. Si no se tiene en cuenta la diversidad, o si los propios desarrolladores proyectan sus prejuicios en el código, el resultado final estará significativamente desviado. Esto en ocasiones se hace además de forma consciente siguiendo las directrices marcadas por una u otra empresa. No es lo mismo pedirle información sobre Corea del Sur a una IA china que a una IA estadounidense, por ejemplo.Interacción y retroalimentación.