Erhalten Sie Zugang zu diesem und mehr als 300000 Büchern ab EUR 5,99 monatlich.

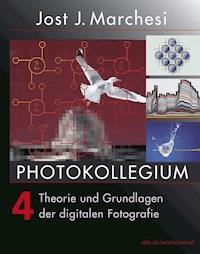

- Herausgeber: Photographie

- Kategorie: Geisteswissenschaft

- Serie: Photokollegium

- Sprache: Deutsch

Die ersten stürmischen Jahre der Digitalfotografiesind Geschichte; verklungen die müßigen Diskussionen, was nun wohl bessersei - die chemische oder die digitale Fotografie. Das ist Grund genug, alle Bereiche der Fotografie in der neuen Reihe PHOTOKOLLEGIUM in sechs Bänden zusammenzufassen. Die aktualisierten Inhalte der früher separat erschienenen Reihe digital- PHOTOKOLLEGIUM sind im Gesamtwerk als Bände 4 bis 6 enthalten. Diese befassen sich mit Theorie und Grundlagen der digitalen Fotografie, Aufnahme und Bildbearbeitung sowie Farbseparation/Farbdruck und Colormanagement. Vermittelt werden die Grundlagen, die es Auszubildenden an Foto- und Fachhochschulen ermöglichen, die notwendige Technik so zu lernen und anzuwenden, dass Bilddaten problemlos, korrekt und nahtlos in den Workflow der digitalen Produktion einfließen. Nach wie vor ist die Qualität eines gedruckten Bildes in erster Linie von der fotografischen Aufnahme abhängig - darüber sind sich alle im Druckvorstufenbereich Tätigen einig. Trotz hochmoderner Computertechnik ist es weder sinnvoll noch wirklich möglich, eine technisch miserable Aufnahme zu einem hochprofessionellen Resultat aufzubereiten. Qualität beginnt immer noch beim seriösen Handwerk - unabhängig davon, ob mit analogen oder digitalen Methoden gearbeitet wird.

Sie lesen das E-Book in den Legimi-Apps auf:

Seitenzahl: 215

Veröffentlichungsjahr: 2012

Das E-Book (TTS) können Sie hören im Abo „Legimi Premium” in Legimi-Apps auf:

Ähnliche

Band4Theorie und Grundlagen der digitalen Fotografie

Prinzip der Digitalisierung

Digitale Bilderfassung

Computer, Schnittstellen, Massenspeicher

Handhabung und Pflege von Daten

Drucksysteme und Digitalbelichter

Jost J. Marchesi

PHOTOKOLLEGIUM

Impressum

Herausgeber

Verlag Photographie

D-82205 Gilching

Layoutgestaltung

forma, ilka-Alexandra Marchesi

CH-8108 Dällikon

Lektorat

ilka-Alexandra Marchesi

Satz

Jost J. Marchesi

© Copyright 2011 by Verlag Photographie

D–82205 Gilching

Alle Rechte vorbehalten, insbesondere die der Reproduktion jeder Art. Wo nichts anderes vermerkt, liegen die Rechte der Abbildungen beim Autor.

1.Auflage 2011

gedruckte Ausgabe:

ISBN 978-3-943125-01-6

E-Book:

ISBN 978-3-943125-57-3

Vorwort

Der Schritt von der herkömmlichen zur digitalen Fotografie ist der vorerst letzte, aber technologisch größte in der langen Geschichte des Mediums, dessen Name frei übersetzt «Zeichnen mit Licht» bedeutet. Für die Nachwelt mag es letztlich gleichgültig sein, ob zur Bildaufzeichnung eines fotografischen Dokuments eine nasse Kollodiumplatte, ein Silberhalogenidmaterial mit gezüchteten Flachkristallen oder eine Art Blackbox mit lichtempfindlichen elektronischen Bauteilen verwendet wurde. Für die Bildermacher dagegen ist der technologische Unterschied bedeutungsvoll. Hieß es doch um die Jahrhundertwende erneut die Schulbank zu drücken und das Wissen um die Eigenarten eines elektronischen Mediums zu erweitern. Vermittlung und Erneuerung von fotografischem Know-how ist seit langer Zeit Aufgabe der Reihe PHOTOKOLLEGIUM. Daher erschienen damals die ersten Auflagen des dreibändigen digital-PHOTOKOLLEGIUMs.

Die ersten stürmischen Jahre der Digitalfotografie sind Geschichte; verklungen die müßigen Diskussionen, was nun wohl besser sei – die chemische oder die digitale Fotografie. Das ist Grund genug, alle Bereiche der Fotografie in der neuen Reihe PHOTOKOLLEGIUM in sechs Bänden zusammenzufassen. Die aktualisierten Inhalte der früher separat erschienenen Reihe digital-PHOTOKOLLEGIUM sind im Gesamtwerk als Bände 4 bis 6 enthalten. Diese befassen sich mit Theorie und Grundlagen der digitalen Fotografie, Aufnahme und Bildbearbeitung sowie Farbseparation/Farbdruck und Colormanagement.

Vermittelt werden die Grundlagen, die es Auszubildenden an Foto- und Fachhochschulen ermöglichen, die notwendige Technik so zu lernen und anzuwenden, dass Bilddaten problemlos, korrekt und nahtlos in den Workflow der digitalen Produktion einfließen. Nach wie vor ist die Qualität eines gedruckten Bildes in erster Linie von der fotografischen Aufnahme abhängig – darüber sind sich alle im Druckvorstufenbereich Tätigen einig. Trotz hochmoderner Computertechnik ist es weder sinnvoll noch wirklich möglich, eine technisch miserable Aufnahme zu einem hochprofessionellen Resultat aufzubereiten. Qualität beginnt immer noch beim seriösen Handwerk – unabhängig davon, ob mit analogen oder digitalen Methoden gearbeitet wird.

Jost J. Marchesi

Inhaltsverzeichnis

Kapitel 22

Prinzip der Digitalisierung

Lektion 101

Digitalisierung des Definitionsbereichs

Nyquist-Theorem

Scanauflösung für Halbtonbilder

Scanauflösung für Strichbilder

Digitalisierung des Wertebereichs

Binäre Mathematik der Grauwerte

Lektion 102

Datenmenge

Die Welt ist farbig

Optische Sensoren

Fotomultiplier

CCD-Sensor

CMOS-APS Microchip

CIS

Kapitel 23

Digitale Bilderfassung

Lektion 103

Spektralempfindlichkeit

Dreifarbenauszug

Scansysteme

Three-Pass-Scan

One-Pass-Scan

Flachbettscanner

Filmscanner

Trommelscanner

Lektion 104

Kamerascanner

Lektion 105

Flächenchip-Kameras

One-Pass mit Dreifachmatrix

Three-Pass mit Einfachmatrix

One-Pass mit Mosaikfilter

One- und Multi-Shot

Microscanning

Image-Tiling, Makroscan

Super CCD

CMOS-Vollfarbsensor

Lektion 106

Problematik bei Bildsensoren

Blooming, Bildrauschen

Aliasing, Oversampling

Tiefpassfilterung

Bildprozessor

Subjektiver Weißabgleich

Chip-Formate und Pixelanzahl

Spezialobjektive für die Digitalfotografie?

Retrofokus und Bildwinkel

Objektivauflösung

Randstrahlenproblem

Nahezu telezentrisch

Lektion 107

Digitalkameras

Display- und Bridgekameras

Spiegelreflexkameras

Professionelle Kamerabacks

Mobilität

Kapitel 24

Computer, Schnittstellen, Massenspeicher

Lektion 108

Aufbau eines Computers, CPU

ROM, RAM

I/O-Einheit, Clock

Bussystem

Bit und Byte

K heißt nicht Kilo

Lektion 109

Betriebssysteme

Cache-Management

Schnittstellen

Erweiterungsschnittstelle

IDE-Schnittstelle

Serial-ATA, SCSI-Schnittstelle

USB, FireWire

Thunderbolt

Lektion 110

Massenspeicher

Magnetische Speicher

Magnetische Wechselplatten

Externe Festplatten, Pocket Drives, USB-Sticks

Optische Speicher

DVD

Blue Ray

Haltbarkeit optischer Speichermedien

Magnetoptische Speicher

LIMDOW-Technologie

Lektion 111

Speichermedien für mobile Kameras

PC-Cards

Compact Flash Card, Microdrive

SmartMedia Card, xD-Picture-Card

Memory Stick, MultiMedia Card

SD Memory Card, iD Photo, Kartenleser

Lektion 112

Bildschirme, Cathode Ray Tube

Bildaufbautechnik

Bildwiederholrate, Bildschirmauflösung

Horizontalfrequenz

LCD-Monitore

Plasmabildschirm

Bildschirme aus organischen Molekülen

Bildschirmspeicher

Signalübertragung

Grafikkarte, Grafikstandards

Kapitel 25

Handhabung und Pflege von Daten

Lektion 113

Datenverwaltung auf Festplatten

Formatieren

Partitionieren

RAID

Images

Defragmentieren

Wartung und Pflege von Mac OS X

Benutzerrechtestruktur

Volume reparieren

Festplattenreparatur

Parameter-RAM löschen

Reset PMU bzw. SMC

Sicherer Systemstart

Unix-Aufräumarbeiten

Cache-Dateien löschen

Prebinding erneuern

Classic-Schreibtischdatei neu anlegen

Kennwort vergessen

Library-Struktur bei OS X

Root-Library

System-Library

Benutzer-Library

Lektion 114

Das Brennen einer CD

Dateiformate und Hierarchie

Disc Burner

Lektion 115

Backup-Strategie

Backup auf Bandmaterial

Kapitel 26

Drucksysteme und Digitalbelichter

Lektion 116

Drucksysteme

Nadeldrucker, Stiftplotter

Laserdrucker

Tintenstrahldrucker

Festkörper-Tintenstrahlverfahren

Flüssig-Tintenstrahldrucker

Tinten- und Tintenstrahldrucker

Tintenstrahldrucker für den Heimgebrauch

Postscript-RIP

Fineart-Print

Tinten

Inkjet-Papiere

Thermotransferverfahren

Thermosublimationsverfahren

Elektrostatikdruck

Silberhalogenid-Pictro-Prozess

Thermo-Autochromverfahren

Filmrecorder

Cathode-Ray-Tube-Belichter

Filmbelichter

Papierbelichter

Lithfilm- und CTP-Belichter

22 Prinzip der Digitalisierung

Digitalisierung des Definitonsbereichs

Bei einem fotochemisch erstellten Bild werden die verschiedenen Graustufen durch unterschiedliche Silbermengen gebildet. Die Feinheit der Struktur, und damit die Größe der kleinsten Bildeinheit, wird durch die relativ ungleichmäßige Anhäufung von Silberpartikeln (Körnigkeitsstruktur) gebildet und diese ist bekanntlich abhängig von der Filmempfindlichkeit und der Entwicklung. Sollen Bilder dagegen in elektronischen Datenverarbeitungsanlagen (Rechnern) gespeichert und dort verarbeitet werden, müssen sie zuerst in eine mathematisch erfassbare, nummerische Form überführt werden. Im Gegensatz zur nicht definierten Anzahl Bildpunkten bei der fotochemischen Verarbeitung, benötigen elektronisch arbeitende Rechner eine endliche Anzahl geografisch eindeutig identifizierbarer Bildpunkte, die jeweils in einer ebenfalls endlichen Anzahl Tonwertstufen definiert sind. Für die computergerechte Aufbereitung muss ein Bild daher zuerst in einen geografischen Definitionsbereich aufgeteilt werden. Sinnvollerweise verwendet man dazu eine Art Gitternetz aus rechteckigen Feldern. In dieser Matrix sind die einzelnen Felder – ähnlich dem Muster eines Schachbretts – durch eine einfache Codierung geografisch bestimmt. Das erste Feld oben links könnte die geografische Codierung A1, das zweite Feld A2 usw. erhalten. In unserem einfachen Beispiel sind die einzelnen Bildelementfelder mit A1 bis Y33 codiert. Die geografische Zuordnung jedes einzelnen, meist quadratischen, gleich großen Bildelements (als picture element oder Pel bzw. Pixel bezeichnet) ist dadurch eindeutig und unmissverständlich. Man nennt diese geografische Aufteilung der Bildmatrix Digitalisierung des Definitionsbereichs oder (in Anlehnung an den praktischen Vorgang) allgemein als Scanning.

Jedes dieser Bildelemente kann nur aus einem einzigen Helligkeits- bzw. Farbwert bestehen. Sind die Bildeinzelheiten des ursprünglichen Bildes oder der Aufnahmeszene feiner als die Größe eines einzelnen Pixels, so besteht der Helligkeits- bzw. Farbwert des Pixels aus der Mischung der im Original an dieser Stelle vorkommenden Helligkeits- und Farbwerte.

Links:

Bildmatrix, Aufteilung des analogen Bildes in ein definiertes Gitternetz. Jedes Feld der Matrix bildet ein Pixel, dessen geografische Lage eindeutig bestimmt ist. In unserem Beispiel wird das Bild in eine Matrix (Bitmap) mit 25 × 33 Bildpunkten (A1 bis Y33) unterteilt.

Rechts:

Digitalisierter Definitionsbereich mit 25 × 33 Bildpunkten (825 Pixel)

Die prozentuale Flächendeckung aller Pixel der Bildmatrix werden bei der Digitalisierung des Definitionsbereichs in einer mathematischen Matrix festgehalten. Hier die Werte unseres Beispiels mit dem Schiefen Turm von Pisa.

Erklärung des Abtasttheorems

Beim Scannen oder bei der direkten elektronischen Bildaufnahme wird gewissermaßen die prozentuale Flächendeckung jedes einzelnen Pixelfeldes gemessen und zusammen mit der geografischen Codierung des betreffenden Pixels in einer mathematischen Matrix gespeichert.

Nyquist-Theorem

Bei der Digitalisierung des Definitionsbereichs stellt sich die Frage, in wieviele Abtastintervalle ein Bild unterteilt werden muss, damit eine möglichst genaue Wiedergabe aller Bildeinzelheiten erreicht wird. In unserem Beispiel mit dem Schiefen Turm von Pisa (er steht heute tatsächlich so schief!) erkennt man deutlich, dass die Aufteilung in nur 25 × 33 Bildpunkte natürlich viel zu gering ist. Man erkennt auf dem digitalisierten Bild das Sujet nur knapp und auch nur, wenn man beim Betrachten die Augen zukneift, um dadurch die Auflösung des Auges merklich zu reduzieren. Die Strukturfeinheit des Originalbildes im Zusammenhang mit der Rastergröße des gedruckten Bildes verlangt eine viel höhere Anzahl Pixel.

Wie groß die Auflösung beim Erfassen des Bildes sein muss, soll Gegenstand unserer Diskussion sein: Von der herkömmlichen Silberfotografie her sind wir uns nicht gewohnt darüber Gedanken zu verschwenden; es ist uns klar, dass ein Kleinbilddia vermutlich zuwenig Bilddaten für die Produktion eines Großplakats haben wird, dass aber umgekehrt, ein 4 × 5 inch Dia mehr als genug Daten für eine ganzseitige Anzeige enthält. Eine Übermenge an Daten belastet uns bei der herkömmlichen Fotografie nicht. Anders bei der digitalen Produktion: hier heißt die Losung nicht «soviel wie möglich», sondern «gerade soviel wie notwendig». Mehr Bilddaten als notwendig schadet zwar der Bildqualität nur bei starkem Herunterrechnen, belastet aber unsere Speicher und den Zeitaufwand für die Bildbearbeitung. Wieviel ist aber «gerade soviel wie notwendig»? Es leuchtet ein, dass die Anzahl Abtastpunkte umso größer sein muss, je feiner das Bild strukturiert ist und je enger der Druckraster gewählt wird.

Genauere Auskunft auf die Frage gibt das Abtasttheorem nach Nyquist (Harry Nyquist: 1924 «Certains Factors Affecting Telegraph Speed» und 1928 «Zeit- und Frequenzdarstellungen von Signalen»). Dieses Theorem (Lehrsatz) beschreibt die mathematische Rekonstruierbarkeit einer periodischen Struktur aus einer Folge von Abtastwerten. Betrachten wir dazu den nebenstehenden Ausschnitt aus einer periodischen Linienstruktur. Würden wir einen Pixel gerade so groß wählen wie die Liniendicke der Vorlage, wäre eine perfekte Rekonstruktion nur dann möglich, wenn der Beginn der Linie gerade mit dem Beginn der Pixelmatrix übereinstimmt (Fall A). Beginnt die periodische Struktur dagegen um eine halbe Pixelbreite verschoben (Fall B), empfängt jeder Pixel nur gerade die Hälfte der Linie, was für den Pixel einer Flächendeckung von 50 % gleichkommt. In diesem Fall würde eine Struktur aus schwarzen Linien als gleichmäßige Graufläche registriert.

Links:

Erfolgt die Abtastung mit zwei Bildpunkten pro Linie (Faktor 2), resultiert eine einwandfreie oder zumindest genügende Wiedergabe.

Rechts:

Diagonal verlaufende Linien verlangen eine hohe Abtastauflösung, um einen sichtbaren Treppeneffekt zu vermeiden.

Links:

Erfolgt die Abtastung mit einem Bildpunkt pro Linie (Faktor 1), ist die Qualität der Wiedergabe von der zufälligen Struktur des Originals abhängig. Im schlechtesten Fall hat die Abbildung keinerlei Ähnlichkeit mit der Vorlage.

Rechts:

Auch runde Formen verlangen eine hohe Abtastauflösung.

Links:

Erfolgt die Abtastung mit 1,5 Bildpunkten pro Linie (Faktor 1,5), ist die Qualität der Wiedergabe ebenfalls von der zufälligen Struktur des Originals abhängig. Allerdings ist auch im schlechtesten Fall noch eine gewisse Ähnlichkeit mit der Vorlage zu erkennen.

Rechts:

Höchste Auflösung verlangen Schriften. Allerdings verwendet man in der Praxis meistens Outline-Beschreibungen (Postscript- oder TrueType-Schriften), deren Qualität nur von der Auflösung des Ausgabegeräts abhängig ist. Wenn dagegen Schriftzüge oder Logos gescannt werden, ist dies nur mit allerhöchster Auflösung und anschließender Umwandlung in eine Outline-Grafik qualitativ genügend.

Folgt man den Untersuchungen von Nyquist, so kommt man zum Schluss, dass die Abtastrate bei der Digitalisierung von Bildern, welche bei der Ausgabe für Druckzwecke gerastert werden, doppelt so groß sein muss, wie die Druckrasterweite. Wird mit einer zu geringen Feinheit (zu große Pixelgröße, zu geringe Auflösung) abgetastet bzw. digitalisiert, entstehen bei Linienstrukturen interferenzartige Störungen, sogenannte Moiré-Effekte. Dieses Phänomen bezeichnet man auch als Aliasing.

Scanauflösung 300 ppi; 1359 × 1332 Pixel (Faktor 2); Dateigröße 1,8 MB

Scanauflösung 225 ppi; 1020 × 1000 Pixel (Faktor 1,5); Dateigröße 1 MB

Für die Bestimmung der notwendigen Abtastauflösung (Scanauflösung) muss auch noch unterschieden werden, ob es sich bei der Vorlage um eine Halbton- oder eine Strichvorlage handelt.

Scanauflösung für Halbtonbilder

Bei Halbtonvorlagen sind die spätere Rasterweite im Druck, der Vergrößerungsmaßstab, aber auch die Strukturfeinheit der Vorlage maßgebend. Wenn wir hier von Scanauflösung sprechen, meinen wir nicht nur die Auflösung beim Scannen eines fotografischen Aufsichts- oder Durchsichtsbildes, sondern ebenso das Erfassen einer zu fotografierenden Szene mittels digitaler Kamera. Es hat sich in der entsprechenden Software eingebürgert, bei der Einleseauflösung von dpi zu sprechen. Dpi bedeutet Dots per inch. Sprachlich ist das nicht ganz korrekt. Diese Auflösungsmaßeinheit stammt ursprünglich von Laserbelichtern. Dort ist die Bezeichnung Dots (Punkt) korrekt. Beim Scannen oder bei der digitalen Fotoaufnahme angemessener ist die Bezeichnung ppi (Pixel per inch). Gemeint ist bei der Bilderfassung aber in beiden Fällen dasselbe. Entsprechend dem metrischen System in Europa spricht man hierzulande auch von dpcm oder ppcm. Die Umrechnung erfolgt mit dem Faktor 2,54 (1 inch entspricht 2,54 cm). Folgt man den Erkenntnissen von Nyquist, so hat die Scanauflösung doppelt so groß zu sein, wie die später im Druck verwendete Rasterfeinheit. Man spricht vom Nyquist-Faktor oder Qualitätsfaktor (QT) 2. Die Druckrastergröße wird entweder in Line per inch (lpi) oder in Linien pro Zentimeter (lpcm) angegeben. Soll ein Bild beispielsweise für diesen Lehrgang auf gestrichenes Papier gedruckt werden, verwendet man einen Kunstdruckraster in der Größe von 60 lpcm oder 150 lpi. Die Digitalisierung des Bildes hat demnach mit 120 ppcm bzw. 300 dpi zu erfolgen. Diese Auflösung muss nur noch mit dem Vergrößerungsfaktor m multipliziert werden. Soll die Wiedergabe doppelt so groß sein wie das zu scannende Bild, ist demnach eine Scanauflösung von 600 ppi gefordert.

Halbtonbilder ohne feine Einzelheiten, bei Druckrasterweiten über 133 lpi oder wenn weniger hohe Qualitätsansprüche gefordert werden, können mit entsprechend niedriger Auflösung abgetastet werden, wobei der Wert der Rasterweite des endgültigen Drucks nicht unterschritten werden darf. Sehen Sie dazu die Bildbeispiele auf folgender Doppelseite.

Ausführliche Praxistests haben gezeigt, dass bei der Scanauflösung für den Ein- oder Vierfarbendruck von Rasterbildern mit einer Rasterweite von über 133 lpi ein Qualitätsfaktor von mindestens 1,5 eingerechnet werden sollte. Bilder mit geometrischen Objekten (z. B. gerade Linien, sich wiederholende Muster) werden besser mit dem höheren Qualitätsfaktor 2 erfasst, ebenso, wenn die Druckrasterweite kleiner als 133 lpi ist. Der Grund, weshalb bei gröberem Druckraster ein höherer Qualitätsfaktor gefordert wird, liegt in der Tatsache, dass fehlerhafte Ausgabe-Rasterpunktdichten bei kleinen Rasterweiten deutlicher erkennbar sind als bei Rasterweiten über 133 lpi.

Diese Empfehlungen beziehen sich auf den konventionellen Rasterdruck. Beim Einsatz des frequenzmodulierten Rasterdrucks (wie ihn beispielsweise vierfarbig gedruckte Tageszeitungen zur Verbesserung der Druckqualität oft verwenden, siehe Band 2 und 3) ist mindestens Qualitätsfaktor 2 (oder höher) zu empfehlen.

Unsere Bildbeispiele auf dieser und der nächsten Doppelseite zeigen die unterschiedliche Druckqualität bei einer Druckrasterweite von 152 lpi und den Qualitätsfaktoren 2; 1,5; 1 und 0,5 bei zwei unterschiedlichen Bildsujets.

Etwas unklar sind die Anforderungen, wenn ein Bild ausschließlich zur ungerasterten Halbtonausgabe auf einem Drucker (zum Beispiel Tintenstrahldrucker oder Sublimationsdrucker) für den fotorealistischen Ausdruck verwendet wird. Solche Drucker arbeiten mit Ausgabequalitäten von 240 bis 1440 dpi. Die Ausgabequalität ist dabei von viel mehr Faktoren als nur der Scanauflösung abhängig. Grundsätzlich gilt bei Sublimationsdruckern die Empfehlung, mit derselben Auflösung (unter Einrechnung des Vergrößerungsmaßstabes m) ein Bild zu erfassen, wie es nachher ausgedruckt wird (QF 1). Bei manchen Ausgabesystemen kann aber oft kaum ein Qualitätsunterschied festgestellt werden, wenn das Bild mit geringerer Auflösung erfasst worden ist. Bei vielen fotorealistischen Tintenstrahldruckern kann man aufgrund der streuenden Spritztechnologie von einer Auflösung ausgehen, die einem Druckraster mit 38 lpi und einem Qualitätsfaktor von 2 entspricht.

Scanauflösung 150 ppi; 680 × 666 Pixel (Faktor 1); Dateigröße 460 KB

Scanauflösung 75 ppi; 340 × 333 Pixel (Faktor 0,5); Dateigröße 115 KB

Scanauflösung 300 ppi; 1359 × 1332 Pixel (Faktor 2); Dateigröße 1,8 MB

Scanauflösung 225 ppi; 1020 × 1000 Pixel (Faktor 1,5); Dateigröße 1 MB

Für die Ausgabe auf einen Dia- oder Farbpapierbelichter (zur Erstellung von Farbdias oder Farbprints aus dem digitalen Datensatz) ist der Qualitätsfaktor 1 zu wählen und die Scanauflösung sollte genau der Ausgabeauflösung mal allfälligem Skalierungsfaktor entsprechen. Dabei errechnet sich die Auflösung des Ausgabegeräts aus der maximal adressierbaren Anzahl Pixel geteilt durch die größte Seitenlänge des Ausgabematerials.

Scanauflösung für Strichbilder

Bei reinen Strichvorlagen sind sowohl die geringste Linienstärke wie die Auflösung des Ausgabegeräts wesentliche Kriterien für die notwendige Abtastfeinheit. Die Scanauflösung muss aber auch hier in den seltensten Fällen die Auflösung der Ausgabe um mehr als Faktor 1 übersteigen, da sonst nur unnötig viele Bildpunkte erfasst werden. Grundsätzlich kann man als Regel für die Scanauflösung annehmen, dass diese der Auflösung des Ausgabegerätes entsprechen soll (selbstverständlich ergänzt um den allfälligen Skalierungsfaktor). Allerdings macht es keinen Sinn, die Scanauflösung auf mehr als 1200 ppi auszudehnen, selbst wenn zur Ausgabe ein Laserbelichter mit der Auflösung von 2400 dpi verwendet wird. Ausführliche Tests haben nämlich ergeben, dass die dabei vom Auge noch erkennbaren Unterschiede derart gering sind und in keinem Verhältnis zu der entsprechend angewachsenen Datenmenge stehen.

Ist die Ausgabe für einen Laserdrucker mit der Auflösung von 600 dpi gedacht, erfolgt nicht der geringste Qualitätsgewinn, wenn das Bild beispielsweise mit 1200 ppi statt mit den notwendigen 600 ppi gescannt wurde.

Digitalisierung des Wertebereichs

Mit der Definition der Bildmatrix ist das Bild erst in einzelne Bildelemente, Pixel unterteilt, deren notwendige Auflösung wir nun für verschiedene Verwendungszwecke kennen. Trotz dieser Aufteilung gilt das Bild immer noch als analog. In unserem Bildbeispiel des Schiefen Turms weist beispielsweise die Fläche des Pixels N 15 eine Flächendeckung von 28 % auf, der Pixel H 28 14 % usw. Mit diesen prozentualen Flächendeckungswerten kann der Computer rechnerisch noch nichts anfangen. Aus diesem Grund ist bei der Digitalisierung ein zweiter Schritt notwendig, bei dem die unendliche Anzahl möglicher Helligkeitswerte eines jeden Pixels in eine bestimmte, genau definierte Anzahl Stufen überführt wird.

Bei der Bilderfassung bzw. beim Digitalisieren wird der Helligkeitswert eines Pixels durch eine analoge elektrische Spannung dargestellt. Dunkle Helligkeitswerte entsprechen dabei einer niedrigen Spannung (zum Beispiel 0 Volt), helle Werte einer hohen Spannung (zum Beispiel 5 Volt) oder umgekehrt. Bei der Digitalisierung des Wertebereichs, auch Sampling genannt, wird in einem sogenannten A/D-Wandler die kontinuierlich variierende analoge Spannung in eine Folge von Stufen mit jeweils einem bestimmten numerischen Wert umgewandelt. In wieviele Stufen die Helligkeitswerte zwischen Weiß und Schwarz umgesetzt werden, ist abhängig von der Ausführung des A/D-Wandlers.

Es stellt sich dabei die Frage, wieviele Stufen mindestens notwendig sind, um einem Bild – trotz Sampling – den Eindruck kontinuierlich verlaufender Helligkeitswerte zu verleihen. Das Maß der Dinge dürfte das Auge des Menschen sein. Der Mensch erachtet in der Regel einen Stufengraukeil, der zwischen den Extremen Weiß und Schwarz 100 Abstufungen aufweist, als kontinuierlichen Verlauf; die einzelnen Stufen können dann kaum mehr unterschieden werden. Gibt man dazu noch genügend Qualitätsreserve, kann man sagen, für die visuelle Betrachtung von Bildern genügen 256 Tonwertstufen. Dabei ist die Zahl 256 nicht zufällig; sie hat vielmehr den Vorteil, dass für die Computercodierung genau 8 Bit oder 1 Byte genügen. Die Zahl ist somit auf die Belange der Computertechnik abgestimmt und bietet Gewähr, für die meisten Zwecke mehr als genügend Tonwertstufen zur Verfügung zu stellen. Unsere elektronischen Bildverarbeitungsprogramme arbeiten bei der Ausgabe mit diesen Werten.

Scanauflösung 150 ppi; 680 × 666 Pixel (Faktor 1); Dateigröße 460 KB

Scanauflösung 75 ppi; 340 × 333 Pixel (Faktor 0,5); Dateigröße 115 KB

Bei der Digitalisierung des Wertebereichs – dem Sampling – werden die kontinuierlich verlaufenden, analogen Helligkeitswerte mittels A/D-Wandlers in ganzzahlige Stufen umgewandelt.

Beim Sampling wird der kontinuierliche, analoge Tonwertverlauf in einen stufenartigen, digitalen Verlauf umgewandelt. Die Grafik zeigt, dass bei dieser Umsetzung mit Informationsverlusten zu rechnen ist. Bei genügender Scanauflösung ist jedoch der Informationsverlust vernachlässigbar klein.

Die binäre Mathematik der Grauwerte

Computer verarbeiten und berechnen Daten mit Hilfe von vielen Millionen «Schaltern», die alle entweder «Ein» oder «Aus» sein können. Tatsächlich kann eine elektronische Datenverarbeitungsanlage letztlich in den Tiefen ihres «Maschinensumpfs» nur zwischen «etwas» oder «nichts», bzw. dem Zustand «1» oder «0» unterscheiden. Mit dieser einfachen Mathematik ist eine Quantisierung des Wertebereichs nur bedingt möglich. Wäre ein Pixel nur entweder 1 oder 0, so entstünde eine reine Strichumsetzung mit den alleinigen Tonwerten Weiß und Schwarz.

Nur Strichbiler (Bi-Level-Bilder) können in einer 1-Bit-Darstellung erfasst werden.

Für das Sampling von Halbtonbildern ist es daher notwendig, der Helligkeit eines jeden Pixels einen ganzzahligen Wert zwischen 0 (Schwarz) und 255 (Weiß) zuzuordnen. Mathematisch nur mit den Ziffern 0 und 1 darstellbar – und somit für den Computer verarbeitbar –, wird dies durch das duale (binäre) Zahlensystem mit den einzigen Werten 0 und 1. Acht solcher Werte – Bit genannt – hintereinandergereiht, ermöglichen so die Darstellung der dezimalen Zahlen 0 bis 255. Der Helligkeitswert eines jeden Pixels ist daher in einem 8-Bit-Code – Byte genannt – gespeichert.

Die Bit-Tiefe sagt aus, wieviele Tonwerte ein Pixel in einer Bitmap (Bildmatrix) haben kann.

Links:

Bei einem 2-Bit-Bild sind 4 Tonwerte inklusive Weiß und Schwarz darstellbar.

Rechts:

Die Anzahl unterscheidbarer Tonwerte ist von der Anzahl Bit abhängig, mit denen ein Pixel codiert wird. 256 Helligkeitswerte einschließlich Weiß und Schwarz reichen in der Regel aus, um einen stufenlosen Verlauf ohne sichtbare Tonwertsprünge zu reproduzieren. Die meisten Bilderfassungsgeräte können (für jede Farbebene) mindestens 256 Tonwertstufen erkennen.

Obwohl praktisch alle Ausgabegeräte ebenfalls nur mit dieser Anzahl Tonwertstufen auskommen, arbeiten moderne Scanner und Digitalkameras mit einer Bit-Tiefe von 10, 12, 14 oder gar 16 Bit und erfassen dadurch mehr als 256 Tonwerte, nämlich bis zu 65 536 (bei einer Bit-Tiefe von 16 Bit). Dieses Supersampling erlaubt die Erfassung und nachherige Verstärkung eines erheblich größeren Bereichs der Schattendetails. Beim Scannen von sehr dichten Dias erhält man so eine deutlich höhere Tonwertflexibilität, das heißt, man kann letztlich in den Schattenpartien einen wesentlich höheren Tonwertreichtum erzielen.

Bei Direktaufnahmen mit Digitalkameras, welche mit einer größeren Bit-Tiefe (mehr als 8 Bit) arbeiten, wird zudem der Belichtungsspielraum deutlich erhöht. Dies gilt aber nur, wenn sowohl die Sensoren, wie auch die gesamte Elektronik entsprechend perfektioniert sind. Ist dies nicht der Fall, kann es vorkommen, dass die Sensoren fälschlicherweise gleiche numerische Werte für unterschiedliche Helligkeitswerte erfassen. Die Angabe über die erfassbare Bit-Tiefe in technischen Datenblättern von Scannern und Digitalkameras sagt daher nicht unbedingt etwas über die effektiv zu erreichende Bildqualität aus!

Tonwertdarstellung bei unterschiedlicher Bit-Tiefe

Links:

Auflösung 50 × 58 PixelBit-Tiefe 1 Bit (2 Tonwertstufen)

Mitte:

Auflösung 150 × 171 PixelBit-Tiefe 1 Bit (2 Tonwertstufen)

Links:

Auflösung 600 × 686 PixelBit-Tiefe 1 Bit (2 Tonwertstufen)

Links:

Auflösung 50 × 58 PixelBit-Tiefe 4 Bit (16 Tonwertstufen)

Mitte:

Auflösung 150 × 171 PixelBit-Tiefe 4 Bit (16 Tonwertstufen)

Links:

Auflösung 600 × 686 PixelBit-Tiefe 4 Bit (16 Tonwertstufen)

Links:

Auflösung 50 × 58 PixelBit-Tiefe 8 Bit (256 Tonwertstufen)

Mitte:

Auflösung 150 × 171 PixelBit-Tiefe 8 Bit (256 Tonwertstufen)

Links:

Auflösung 600 × 686 PixelBit-Tiefe 8 Bit (256 Tonwertstufen)

Arbeitet ein Bilderfassungsgerät mit einer höheren Bit-Tiefe, werden die Daten bei der Übertragung zum Computer entweder durch manuellen Eingriff des Operators oder automatisch durch die Software gesteuert, einem Downsampling auf 8 Bit unterzogen. Moderne Bildverarbeitungsprogramme können allerdings intern mit 16 Bit arbeiten und einige wesentliche Funktionen (wie zum Beispiel Gradations- und Farbkorrekturen) mit dieser großen Datenmenge durchführen, bevor für die Ausgabe das Downsampling auf 8 Bit vorgenommen wird.

Datenmenge

Scanauflösung, Größe der Reproduktion und Anzahl Farben bestimmen die zu erwartende Datenmenge. Die Scanauflösung in ppi oder ppcm im Quadrat ergibt die Anzahl Pixel pro Quadratinch bzw. Quadratzentimeter. Wird diese Zahl multipliziert mit der Fläche des Reproduktionsformats in Quadratinch bzw. Quadratzentimeter, erhält man die Gesamtheit aller Bildpunkte pro Farbebene. Bei mehrfarbigen Bildern vergrößert sich die Menge der Bildpunkte mit der Anzahl Farbebenen (n). Wenn wir davon ausgehen, dass jeder Pixel mit 8 Bit (1 Byte) codiert ist, entspricht die Anzahl Pixel bei einem Graustufenbild genau der Anzahl Byte. Bei einem Dreifarbenbild (RGB) ist die Datenmenge dreimal, bei einem Vierfarbenbild (CMYK) viermal größer. Die Bit-Tiefe beeinflusst die Datenmenge proportional. Bei Erhöhung der Bit-Tiefe von 8 Bit auf 1 Bit, fällt die doppelte Datenmenge an. Noch stärker beeinflusst der Qualitätsfaktor (QF) die Datenmenge: Erhöht man den Qualitätsfaktor von 1 auf 2, wird die Datenmenge vervierfacht.

Bei Digitalkameras mit Flächenchips ist die Auflösung und dadurch die Datenmenge nicht veränderbar. Hier interessiert in erster Linie, wie groß das maximale Druckformat bei einer Aufnahme sein kann.

Wie in der herkömmlichen Farbfotografie erfasst auch die elektronische Bildaufnahme je einen Drittel des sichtbaren Spektrums. Die drei Teilauszüge R, G und B addieren sich wieder zur originalen Farbinformation.

Bei fotorealistisch arbeitenden Tintenstrahldruckern kann man von einer Auflösung ausgehen, die einem Raster mit 15 lpcm (38 lpi) und einem Qualitätsfaktor von 2 entspricht (Anzahl Lichtsensoren pro Zeile geteilt durch 30).

Die Welt ist farbig

Seit bald hundert Jahren begnügt sich die Fotografie nicht mehr ausschließlich mit schwarzweißen Darstellungen. Selbstverständlich ist auch die digitale Fotografie nicht nur monochrom. Der Vorgang der Farberfassung ist sowohl bei der digitalen Direktaufnahme wie beim Scannen derselbe wie in der herkömmlichen Fotografie: Jedes Spektraldrittel wird einzeln erfasst. So erhält man bei einer 8-Bit-Codierung je 256 Helligkeitswerte für die Kanäle Rot, Grün und Blau, was zusammen 16 777 216 Farbwerte ergibt. Die 8-Bit-Codes für Rot, Grün und Blau werden dabei einfach aneinandergereiht, wobei ein 24-Bit-Code als RGB-Signal entsteht.

Das Erfassen der Spektraldrittel Rot, Grün und Blau erfolgt dabei durch sogenannte Selektionsfilter (Farbauszugsfilter), welche die Eigenschaft haben, von der farbigen Vorlage nur jeweils den Rot-, Grün- oder Blaubereich durchzulassen und die übrigen Farbwerte zu sperren. Es entsteht ein korrekter Dreifarbenauszug.

Bei Selektionsfiltern für die direkte Bilderfassung mit einer Kamera müssen sich die Durchlässigkeitsbereiche für die einzelnen Spektraldritel leicht überlappen. Man verwendet dazu sogenannte Breitbandfilter. In Scannern, die ausschließlich für das Digitalisieren von farbfotografischen Originalen (Dias, Farbprints) vorgesehen sind, setzt man Schmalbandfilter ein, deren Durchlassbereiche sich nicht überlappen, da bei Fotografien der eigentliche Farbauszug ja bereits bei der Aufnahme gemacht worden ist. Weiterführende Informationen über farbtheoretische und farbmetrische Grundlagen finden Sie in der vorliegenden Reihe PHOTOKOLLEGIUM Band 6.

Der rote Selektionsfilter lässt nur das rote Spektraldrittel passieren. Es entsteht der Rotauszug, dessen Daten (Rotkanal) die gesamte Rotinformation des Bildes enthalten.

Der grüne Selektionsfilter lässt nur das grüne Spektraldrittel passieren. Es entsteht der Grünauszug, dessen Daten (Grünkanal) die gesamte Grüninformation des Bildes enthalten.

Der blaue Selektionsfilter lässt nur das blaue Spektraldrittel passieren. Es entsteht der Blauauszug, dessen Daten (Blaukanal) die gesamte Blauinformation des Bildes enthalten.

Optische Sensoren

Bei der elektronischen Bilderfassung werden grundsätzlich die optischen Signale der Vorlage in elektrische umgewandelt. Das von der Vorlage ausgehende Licht trifft auf einen optischen Sensor, der proportional zur Beleuchtungsstärke ein elektrisches Signal bildet, das anschließend durch einen A/D-Wandler digitalisiert wird, sodass dieses von Computern gespeichert und verarbeitet werden kann.

Für die Umwandlung von Licht in elektrische Signale sind unterschiedliche Sensortypen im Einsatz. Die technischen Merkmale und die Funktionsweise der Sensoren bestimmen Konstruktion und Verwendungszweck der elektronischen Bilderfassungsgeräte. Unter diesen Kriterien kann man im Wesentlichen mehrere Hauptgruppen von optischen Sensoren unterscheiden:

Informationsfluss bei der elektronischen Bilderfassung

Prinzip des Fotomultipliers

Ausführungsformen von Fotomultipliern. Rechts außen ein Videotron (Videoröhre aus einer Fernseh-Röhrenkamera)

• Fotomultiplier

• CCD-Zeilen- und Flächensensoren

• CMOS-APS Microchip

• CIS, Contact Image Sensor